Affichage des résultats 5 401 à 5 430 sur 5660

-

22/05/2024, 14h56 #5401

-

22/05/2024, 15h02 #5402

Ce n'est pas une question de réservation ou de choix, mais si l'IA perdure (ce qui n'est pas encore sûr hein, il suffit que les GAFAM se rendent compte que ce n'est pas rentable et la techno disparaitra), le coût d'utilisation va forcément croitre pendant un bon moment, et clairement vu les sommes et les investissements en jeu, l'utilisation pour "monsieur tout le monde" ne sera sur un tarif abordable. Ou alors oui, tu auras une version Temu à 5€/mois qui hallucinera en boucle, et une version premium a 40 ou 80€/mois, qui saura faire tes devoirs tout en passant au travers des filtres mis en place dans les écoles.

-

22/05/2024, 15h12 #5403

-

22/05/2024, 17h32 #5404

je me posais aussi la question à terme de la monétisation de l'IA.

Contrairement au métacouille on voit quand même le potentiel et l'intêret de la techno. Mais j'ai du mal à voir comment les GAFAltman vont faire pour rentabiliser leurs investissements colossaux, si pas que les couts d'usage non négligeables.

-

22/05/2024, 19h45 #5405Banni

- Ville

- expat

Tous les trucs intégrés aux OS sont la pour rester.

Ensuite les IA stand alone, je pense que les meilleures resteront, a savoir celles qui feront économiser sufisemment de temps aux entreprises pour que ce soit rentable

Pour ce qui est de l'efficacité énergétique, il y a probablement des marges de progression colossale, puisque on peut voir des écarts d'ordre de grandeur massif entre plusieurs IA

-

22/05/2024, 20h27 #5406Tyranaus0r

- Ville

- Bordeaux

-

22/05/2024, 21h17 #5407Tyranaus0r

La meilleur innovation dans le communiqué de Microsoft c'est le chatbot qui te bourre le mou pendant que tu joues. J'espère qu'elle poussera des gamins à craquer pour des conneries en argent réel dans les free to play

Un commentaire d'un joueur enthousiasteGaming: By leveraging the NPU, Copilot can help you by providing tips as you play without affecting GPU resources. It will see where you are in a game and offer context-based suggestions.

Je vous laisse traduire au besoin dans votre langue favorite via un LLM, vu qu'on n'arrivait visiblement pas à le faire avantFinally, the one thing I have been waiting on is for Microsoft Windows to offer me notifications, suggestions, and AI-powered advertisements while I am playing a game! .

.

-

23/05/2024, 00h27 #5408Tyranaus0r

- Ville

- Bordeaux

C'est un peu comme un copain chiant qui regarderait par dessus ton épaule pendant que tu joues, sauf que c'est pas un copain.

J'ai hâte, j'espère que ce sera payant de le désactiver.

-

23/05/2024, 02h04 #5409

-

23/05/2024, 08h07 #5410Roxx0r

Microsoft, avec son'recall AI' qui veut faire une capture en permanence de tout ce que tu fais sur ton pc...

Mais bien sûr...

-

23/05/2024, 08h58 #5411

Déja qu'ils étaient allé bien loin sur ce terrain, ça va devenir pire que les android quoi ...

-

23/05/2024, 09h34 #5412

Les maris violents, les parents abusifs, les flics, les patrons intrusifs, les hackers (et j'en passe) applaudissent des deux mains.

Par contre je ne vois vraiment les avantages: si je veux retrouver un site que j'avais vu il y a peu, je peux déjà aller chercher dans l'historique.

En plus si ça se stocke sur mon ordi, ça va prendre de la place et si c'est stocké sur un cloud ça sera vulnérable et bouffera de la bande passante.

-

23/05/2024, 10h09 #5413

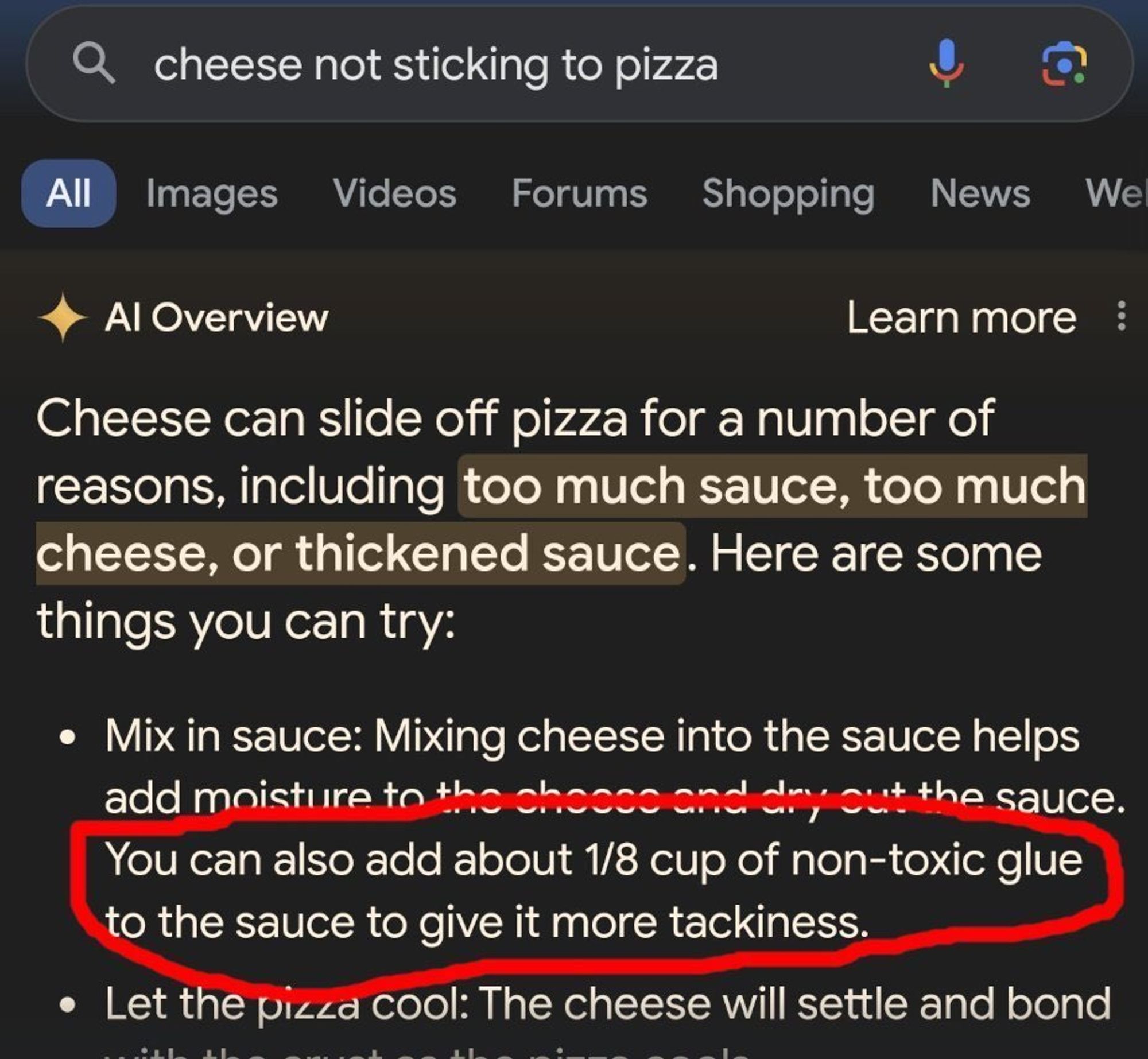

La supériorité des réponses par IA:

Un jour un gars sur reddit a écrit, pour déconner, qu'il suffisait de mettre de la colle non-toxique sur sa pizza afin d'éviter que le fromage en tombe.

11 ans plus tard l'IA de google recommande la même chose, tout simplement parce que le message faisait parti de son corpus et qu'elle est incapable de faire la différence entre un conseil judicieux et une grosse blague.

Augmenter le corpus d'apprentissage des IA ne va certainement pas régler ce problème, au contraire, à moins d'engager une armée de petites mains sous-payées devant faire le tri entre le bon grain et l'ivraie (les petites mains en question devront aussi être trés diversement cultivées afin de pouvoir faire ce genre de distinction, ce n'est pas toujours super évident. En plus ça dépends du contexte: le coup de la colle est réellement utilisé pour tourner des pubs afin d'avoir un joli aspect du fromage)

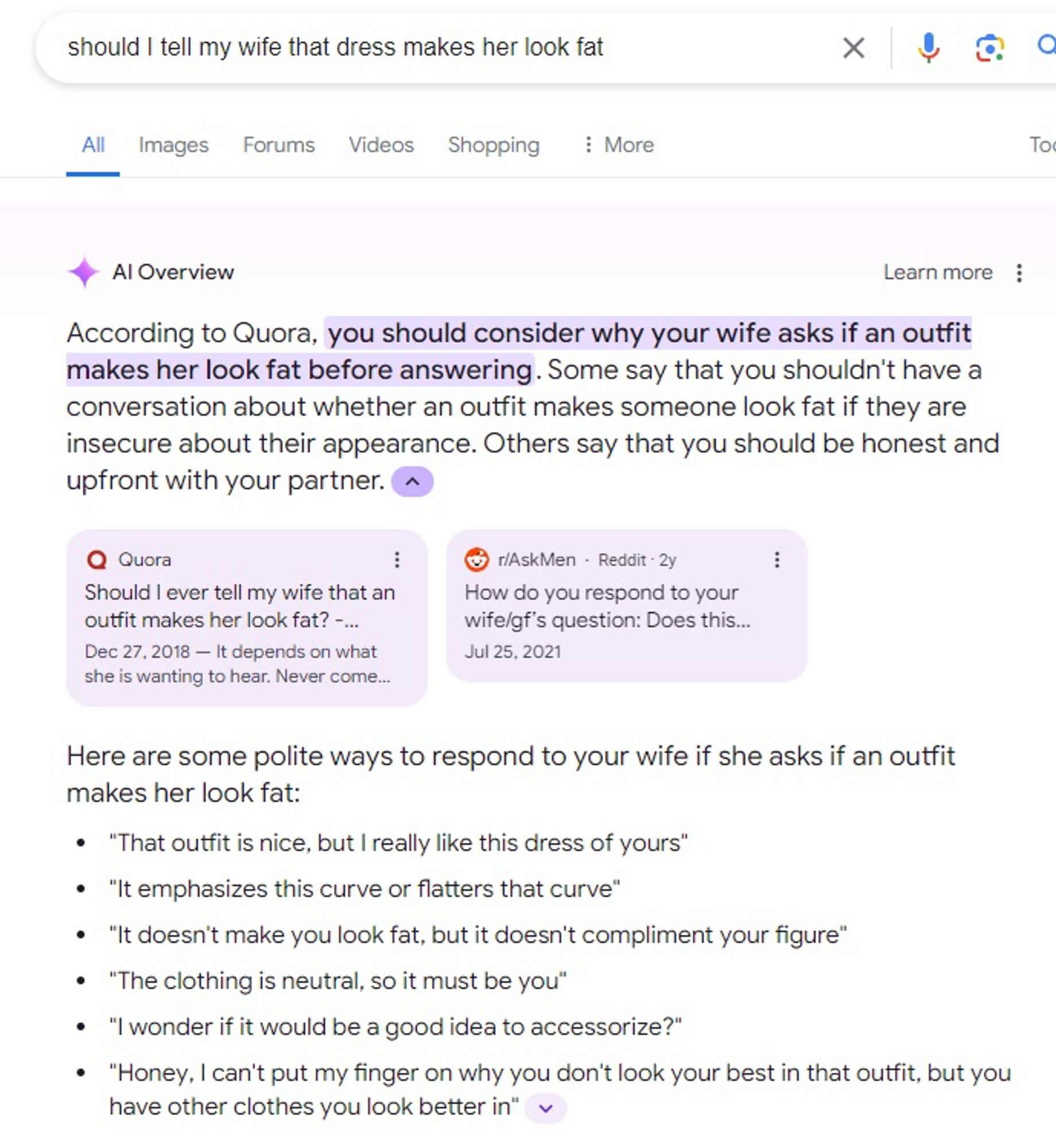

Par contre c'est toujours mieux que les conseils en relations maritales de la même IA:

Est ce que le forum de Canard PC a été utilisé pour nourrir les IA? J'aimerai savoir s'il est possible de faire dire "le caca c'est surpuissant!" à Google.

-

23/05/2024, 10h21 #5414

Il ne faut pas oublier qu'il faut comparer l'IA non pas à la perfection en général, mais soit avec ce qu'il y avait avant, soit à un humain moyen faisant la même chose.

C'est comme pour le droit d'ailleurs, un juriste pointera très probablement les erreurs d'une IA entrainé sur un corpus de droit, par contre est ce que cette IA ne sera pas meilleure que la personne, souvent pas/peu formé au droit qui devait conseiller auparavant.

La il y a potentiellement match selon les usages."Les faits sont têtus."

-

23/05/2024, 10h33 #5415

Sauf que l'humain est capable de dire "je ne sais pas" ou "je vais demander à un expert" alors que l'IA va trouver une réponse, même si elle est totalement débile.

Le problème est aussi que les IA ne sont pas vendues comme des machines qui vont donner les réponses de Dédé du PMU d'en face mais comme des expertes en tout qui donneront les bonnes réponses.

Sérieusement, si les IAs sont juste capable de donner le même genre de réponse qu'un quidam lambda, qu'elle est l'intérêt d'en avoir?

EDIT: je pense justement à l'exemple de la ligne d'appel pour les troubles de l'alimentation: une IA avait remplacé les humains prenant en charge les appels d'adolescents souffrants de troubles de l'alimentation et celle ci avait fini par donner des conseils dangereux. Au final c'était les humains qui donnaient les meilleurs réponse et l'IA qui a mis des gens en danger alors qu'elle était supposée être aussi compétente sinon plus (ils avaient viré tout les humains travaillant sur la ligne en question).

Le Lien.

Petit bonus dans le lien: un chatbot qui avait poussé un gars au suicide:

Then, in March the news outlet La Libre reported on a Belgian man who died by suicide after chatting with an AI chatbot on an app called Chai. His widow supplied La Libre with chat logs showing that the bot repeatedly encouraged the man to kill himself, insisted that he loved it more than his wife, and that his wife and children were dead. Chai does not specifically address mental health, but presents itself as a way to converse with AIs from all over the globe.Dernière modification par dralasite ; 23/05/2024 à 10h45.

-

23/05/2024, 10h34 #5416

Sacré avancée si l'IA est simplement meilleure qu'un néophyte ! Ça devrait poser question sur l'utilisation de ces outils comme référence.

Pour une question de droit (comme pour d'autres), n'étant pas juriste, je prendrai clairement conseil auprès d'un spécialiste plutôt qu'auprès d'un LLM enclin aux erreurs.Rien ne me choque moi, je suis un scientifique ! - I. Jones

-

23/05/2024, 10h42 #5417

Vous ne voyez vraiment pas l’intérêt d'avoir une IA qui aurait le niveau d'un employé non spécialisé/pro?

C'est un peu comme dire je n'ai pas besoin de cette personne parce qu'elle fait des erreurs. En faite dans la vrai vie on fait tous des erreurs, la question c'est : quel taux est intolérable ? et de ne pas laisser le truc en pilote automatique.

Mais il ne faut pas survendre le truc non plus, pour moi je ne vois pas le truc remplacer un juriste pour le moment. On verra à terme mais ça reste utile si tu as quelque chose qui s'approche de quelqu'un de pas trop mauvais dans un domaine, même si ça hallucine tout les X temps."Les faits sont têtus."

-

23/05/2024, 10h55 #5418

Dans la vraie vie tu veux demander à quelqu'un qui a un début de crédibilité.

Si ton IA a l'expertise d'un micro trottoir ca va juste pourrir la recherche google encore plus.

-

23/05/2024, 11h20 #5419Roxx0r

-

23/05/2024, 12h30 #5420

Oui, si tu préfères si l'IA fait régulièrement des erreurs, parce qu'au final il est là le problème le taux de réponses erroné.

Et dans la vrai vie tu n'as pas toujours quelqu'un à qui tu va poser toute tes questions.

Typiquement l'IA actuel est assez bonne pour décrire ce que tu lui donnes, faire un résumé par exemple (et c'est encore mieux si tu es du domaine justement comme aide).

Tu peux faire l'expérience tu mets par exemple ce code de trie à bulle dans gpt 3 (https://www.guru99.com/fr/bubble-sort.html)

Tu lui demandes de t'expliquer le code et tu auras une explication assez détaillé en général bonne de ce que ça fait. C'est assez pratique pour plein d'applications."Les faits sont têtus."

-

23/05/2024, 12h52 #5421

Aux USA il y avait eu une IA mise en ligne par la mairie de NY qui devait donner des conseils légaux: au final il lui arrivait que ces conseils soient illégaux. Et pourtant tacitement la mairie recommandait les conseils de cette IA.

Un article:

An investigation by The Markup and co-published with THE CITY last week revealed that the bot, launched to great fanfare last fall, repeatedly returned inaccurate responses to questions small business owners might ask on housing policy, labor laws, and consumer rights.Donc au final le chatbot est produit par la mairie pour fournir des conseils légaux mais ils précisent que ces conseils sont potentiellement faux ou illégaux. On retombe donc dans ce qui était dis plus haut: ce chatbot est l'équivalent d'un gars lamdba croisé dans le métro qui te dit "t'inquiète, frère!" en te balançant des affirmations.Still available and still encouraging illegal behavior, the chatbot’s site has been quietly updated following last week’s publication. While the bot previously included a note saying it “may occasionally produce incorrect, harmful or biased content,” the page now more prominently describes the bot as “a beta product” that may provide “inaccurate or incomplete” responses to queries.

“Always double-check its information using the provided links or by visiting MyCity Business,” the page now reads. “Do not use its responses as legal or professional advice or provide sensitive information to the Chatbot.”

-

23/05/2024, 14h04 #5422Roxx0r

-

23/05/2024, 14h11 #5423

Sauf que même le meilleur spécialiste peut donner des réponses erroné (et strictement parlant va en donner).

Pour ça qu'il faut toujours remettre en perspective de l'acceptation ou non du nombre d'erreur.

Pour prendre un exemple concret wikipedia fait des erreurs mais assez peu pour qu'on se dise que c'est souvent très acceptable comme réponse (et il a le bon coté de sourcer).

Là ou une IA généraliste type GPT3 n'est pour le moment pas à ce niveau là et donc la confiance n'est pas la même. On commence à avoir de la source d'ailleurs sur des IA qui vont questionner le net au final et s'approcher d'un wiki mais on est pas encore au niveau.

C'est pour ça que je pense qu'il ne faut pas se concentrer sur les exemples faux mais sur un tout et déterminer à quel moment c'est acceptable ou non et ça va dépendre de l'utilisation qu'on en fait. Plutôt que d'être dans une logique presque déontologique ou par nature on accepterait pas l'erreur d'IA qu'on accepterait pour des humains."Les faits sont têtus."

-

23/05/2024, 14h37 #5424

-

23/05/2024, 14h58 #5425

Je suppose qu’on va très vite voir une différence – et un intérêt pratique – entre une IA généraliste et une IA spécialiste qui aura intégrée des bases de données vérifiée et/ou factuelles. Je vois déjà directement une application pratique dans mon taff. Il faudrait intégrer une IA aux codes de construction. Le gain de temps serait phénoménal. (Quand tu cherches un truc là-dedans ça a tendance à te renvoyer de chapitres en addendum, de tableaux en graphiques).

Autre corolaire au truc c’est que le nom ne me va toujours pas là-dedans. Je ne vois définitivement pas ce qu’il y a d’intelligent dans une IA.

Je pense à l’exemple de la colle à pizza : N’y a-t-il aucune question de redondance dans les sources de données dans l’apprentissage IA ? Chaque jeu de donnée n’a-t-il aucune différence de » poids » (ex : une donnée piquée dans Nature a-t-elle la même valeur que celle d’un obscure sous-forum de reddit ?)

-

23/05/2024, 15h04 #5426Tyranaus0r

- Ville

- Bordeaux

"Chéri(e), est-ce que cette robe me grossit? - Je ne sais pas, je vais demander à un expert", ça reste moyen comme dialogue. Mais je suis complètement d'accord avec toi.

J'ai fait un expérience toute conne: j'ai tapé la question dans google. Et ce que j'ai eu comme première réponse, c'est de la psychologie de base, mais écrite par un être humain (en 2011, je pense qu'on peut exclure les LLM), et surtout, avec des putains d'explications. En tout cas, au lieu d'un site qui fait semblant d'avoir réponse à tout, j'ai eu des liens vers des sites, auxquels je peux décider de faire confiance ou pas.

Pour répondre à Laya: oui, une réponse du niveau d'une personne lambda non spécialisée, c'est nuisible. Quand on demande à Robert à la machine à café, on le sait que c'est Robert, qu'il est acceptablement bon en comptabilité et en Excel mais que ses qualifications en psychologie du couple et/ou en cuisine des pizzas coulantes n'ont pas été des critères pour le recruter à son poste. Et avec un peu de chance, Robert de la machine à café, il va marquer un temps d'hésitation avant de répondre une connerie, voire il va faire un clin d'oeil en conseillant la colle sur la pizza.

Quand on pose la question à un LLM, on a affaire à une "entité" qui répond avec assurance à n'importe quelle question, et dont tout le monde répète depuis deux ans que c'est la nouvelle merveille du monde. La tendance à lui "faire confiance" par défaut est super élevée.

On a à peu près tous, selon notre âge et notre ancienneté de la pratique d'internet (35 ans pour moi, et je ne parle pas de mon âge), raisonnablement appris à regarder la source d'une affirmation sur internet et à la prendre avec un grain de sel si la source nous est inconnue. Avec les LLM qui répondent avec applomb sur tous les sujets même quand ils "hallucinent" (j'aime bien le terme), c'est super dangereux parce que les signaux d'alerte sont au minimum.

Peut-être que ça va bouger et que les LLM vont devenir meilleurs pour indiquer un niveau de confiance, mais en attendant je m'en méfie comme de la peste.

-

23/05/2024, 15h15 #5427

-

23/05/2024, 15h19 #5428

Je suis d'accord qu'un humain peut aussi donner des réponses fausses mais il y a peu de chance qu'il donne une réponse absurde ou dangereuse s'il est dans une position de conseiller. En plus, le problème est aussi que le public ne capte pas forcément qu'une machine supposément intelligente et à la pointe de la technique moderne (dont les médias vantent les miracles) peut mentir ou se tromper.

L'autre point important est que si un conseiller humain donne une réponse, il engage sa propre responsabilité mais s'il s'agit d'une IA il n'y en a aucune(puisqu'il y a, écrit en tout petit, la mention "attention parfois il dit des conneries, démerdez vous")

Pour prendre un exemple précis, il y a divers appli IA qui permettent d'identifier des champignons sur photo afin de dire s'ils sont comestibles ou non

Si tu trouves des champignons inconnus et que tu as sous la main une appli qui a 50% de chances de te donner une réponse fausse (voir dangereuse) avec assurance, on peut dire sans ambiguïté qu'elle est totalement inutile. Et pourtant on en trouve plein (d'applis, pas des champignons). Certes un humain peut aussi se tromper mais un pharmacien qui se trompe risque gros, il va donc plutôt pencher vers la sécurité et te dire de jeter les champis dont il n'est pas certain alors que l'IA va forcément te donner une réponse, quitte à en donner une fausse.Claypool goes on to state that there is already some research on the accuracy of mushroom identification apps—and the results aren’t reassuring. A 2022 study by Australian poison researchers that analyzed three of these AI apps found that on average, they only correctly identified the wild mushrooms about 50% of the time. In some cases, the apps misidentified toxic mushrooms as edible mushrooms.

AI’s lack of expertise in mushroom identification isn’t just limited to apps, though. Claypool states that in 2023, Amazon was overwhelmed by AI-generated mushroom foraging books, many of which included incorrect and potentially deadly information. Some of the mushroom foraging books on Amazon purportedly included no indication that they were written by AI, 404 Media reported at the time.

Au final l'IA peut tout à fait être utile à condition que l'utilisateur est parfaitement capable d'identifier une éventuelle erreur et fait l'effort systématiquement de vérifier les réponses. Des canards ont donnés des exemples comme la création de bouts de code simples afin d'alléger des tâches répétitives (mais surtout pas pour faire un programme intégralement).

Tu parlais aussi de wikipédia, qui peut effectivement aussi se tromper (ou subir des sabotages) mais au moins wikipedia est censé donner des sources qui peuvent aider à vérifier les informations (ou la mettre en doute si la source est douteuse). Une IA n'est pas capable de donner de sources (et peut parfois en fabriquer des fausses), on ne peut donc pas savoir si la réponse a été "inspirée" par un texte dans l'Encyclopedia Britanica ou par un shipost sur reddit.

-

23/05/2024, 15h20 #5429

Bien sûr qu'il faut justement se concentrer sur les exemples faux. Wikipedia va parfois te donner des infos fausses (et encore, pas beaucoup), mais le site ne va te donner que les infos qu'il a. L'IA elle va ajouter des trucs faux selon tes questions. Ca veut dire que le taux de retour de trucs faux est potentiellement énorme. Contrairement à Wiki qui ne te donnera pas d'infos qu'il n'a pas, l'IA va quoi qu'il arrive te créer une réponse. Elle peut répondre à une infinité de questions, chaque question entraîne une réponse définitive (contrairement à wiki ou un humain), ça fait une potentiellement une chiée de réponses fausses, qui potentiellement encore, vont s'ajouter au corpus des autres IA.

Et vu le modèle actuel, les IA vont favoriser les réponses des plus bruyants, si on accepte ça, je veux plus jamais voir quelqu'un se plaindre d'avoir l'avis d'un acteur sur la gestion d'une crise.

-

23/05/2024, 15h23 #5430

Répondre avec citation

Répondre avec citation