Mais comment, réellement, on est passés des problèmes d'IA aux obsessions politiques de Nilsou? (le seul point commun étant Nilsou)

Affichage des résultats 4 411 à 4 440 sur 5298

-

20/03/2023, 19h10 #4411Tyranaus0r

- Ville

- Bordeaux

-

20/03/2023, 19h11 #4412

La Chine a bien 50 ans de retard oui.

La guerre n'est pas une maladie ça se déclare, les guerres que je cite sont des guerres alimentés par des occidentaux.

Et pour revenir au sujet, ici sur cet exemple précis c'est les USA qui semblent à condamner effectivement. Ils veulent garder un quasi monopole qui est d'ailleurs assez nuisible pour l'Europe aussi sur le sujet. (Et le dire ce n'est pas préférer le modèle Chinois au modèle américain)."Les faits sont têtus."

-

20/03/2023, 20h13 #4413

-

21/03/2023, 15h47 #4414

OpenAI a sorti un papier discutant l'impact des LLMs sur l'emploi: https://arxiv.org/pdf/2303.10130.pdf

-

21/03/2023, 16h11 #4415Banni

Pouah j'étais parti sur un long post d'injures, je vais rester sobre, c'est un torchon ce papier. Même pas du niveau d'un TPE de lycéen. Même la page qu'ils passent à décrire les biais de """l'étude""" ils se touchent sur les capacités du modèles, c'est incroyable, y'a rien qui va, rien.

Nan mais c'est pas possible ils vont passer pour des guignols à publier des trucs comme ça, c'est un délireDernière modification par Anonyme20240202 ; 21/03/2023 à 16h23.

-

21/03/2023, 16h36 #4416Banni

Allez, on va essayer de trouver les pépites qui résument tout le papier

- - - Mise à jour - - -E1 – Direct exposure

Label tasks E1 if direct access to the LLM through an interface like ChatGPT or the OpenAI playground

alone can reduce the time it takes to complete the task with equivalent quality by at least half.

This includes tasks that can be reduced to: - Writing and transforming text and code according to complex instructions,

- - - Mise à jour - - -If indeed,

the task-based breakdown is not a valid representation of how most work in an occupation is performed,

our exposure analysis would largely be invalidated.

- - - Mise à jour - - -Lack of expertise and task interpretation. Human annotators were mostly unaware of the specific

occupations mapped to each DWA during the labeling process.

aka sorti de mon culβ, which is the sum of E1 and 0.5*E2, where the 0.5 weight on E2 is intended to account

for exposure when deploying the technology via complementary tools and applications necessitates additional

investment

- - - Mise à jour - - -

On fait ce qu'on veut et on t'emmerde lolRecent research indicates that GPT-4 serves as an effective discriminator, capable of applying intricate

taxonomies and responding to changes in wording and emphasis.Dernière modification par Anonyme20240202 ; 21/03/2023 à 17h00.

-

21/03/2023, 16h44 #4417

Hahaha comme t'y vas

Perso ça m'a moins choqué que toi, ça vaut ce que ça vaut, ça prouve pas grand chose et y'a beaucoup de pifomètre et d'heuristique mais c'est dans la ligne de ce style de travaux d'économiste et j'ai trouvé ça intéressant de voir décomposer ça comme ça alors que jusqu'ici c'est pas exactement le style de boulots que les LLMs pourraient faire qu'on considérait les plus menacés.

Si ça peut te rassurer je l'ai vu se faire allumer par pas mal de gens y compris des économistes, OpenAI a une comm un peu zarb aussi et y'a de moins en moins de gens pour leur donner le bénéfice du doute.

-

21/03/2023, 16h55 #4418Banni

On rajoutera qu'utiliser O*NET a le même niveau de sérieux que les recommandations de job de l'ANPE

- - - Mise à jour - - -

Nan mais c'est un truc de dingue à quel point c'est mauvais. Genre d'une part y'a la méthodologie. Même en acceptant TOUTES leur "heuristiques" (une heuristique c'est défini normalement, c'est sérieux une heuristique, ça se mesure, tu poses une fusée sur la lune avec une bonne heuristique), c'est une catastrophe

La rédaction de l'intro et la conclusion sont littéralement un travail de collégien.

Nan mais lis moi ça quoi. On dirait un élève en galère qui brode quand on annonce qu'il reste 20 min avant la fin de l'examOur research aims to highlight the general-purpose potential of GPTs and their possible implications for

US workers. Previous literature demonstrates the impressive improvements of GPTs to date (see 2.1). Our

findings confirm the hypothesis that these technologies can have pervasive impacts across a wide swath of

occupations in the US, and that additional advancements supported by GPTs, mainly through software and

digital tools, can have significant effects on a range of economic activities.

---

Mais à vrai dire, le plus gros problème dans l'absolu, c'est que ce papier n'est pas self-consistent/self-coherent. Genre y'a des hypothèses définies, puis ensuite ils en rajoutent d'autre en plein milieu arbitrairement.

Genre tu définis une méthodologie qui est en gros un sondage. Pourquoi pas, on est plus sur de la sociologie mais allons y. Mais ensuite tu te tiens, et si je regardais la corrélation entre le sondage et ce que me dit mon IA (qui en plus est l'IA en question dans l'étude, c'est pas sérieux), et on va dire que si on a une corrélation satisfaisante alors le résultat est... euh ça veut dire quoi en fait, euh... doublement accepté?... Y'a rien qui justifie ça, c'est pas déclaré a priori.

Pareil pour le 50% arbitraire qui est glissé dans la présentation des labels mais qui ensuite tu découvres qu'il fait parti du label et que tu dictes aux sondés ce qui représente une tâche améliorable à 50%

Enfin c'est n'importe quoi, et puis tiens à la fin, histoire de faire peur à madame michu, on va rajouter les salaires dans l'équation, parce que, on avait envie

Ca n'a ni queue ni tête, c'est n'imp

- - - Mise à jour - - -

'Fin bref ça ne vaut même pas la peine d'en parler, mais je savais pas qu'OpenAI faisait des publications de ce genre.

Ca me rappelle le fameux proverbe (je dis ça pour l'équipe qui a publié ça hein)

"Better to remain silent and be thought a fool than to speak and to remove all doubt"

Puis ça me rappelle aussi "les cons ça ose tout, c'est même à ça qu'on les reconnait" lol.

Enfin, vu la gueule des auteurs, je pense que l'équipe d'ingés n'y est pour rien. Ils ont du tous se faire un facepalm collectifs en voyant ça. C'est le cas typique du département marketing qui se sent pousser des ailes haha

-

21/03/2023, 17h09 #4419Banni

Après l'idée est intéressante hein. Genre je connais pas les stats de boulots principalement face à un ordi dans le monde vs. boulots manuels (je simplifie) etc. Donc l'idée d'exposure est pas mauvaise, mais c'est tellement mal fait là que c'est dur de se concentrer sur le positif.

Allez, 8/20 et un devoir maison supplémentaire qui vaudra 2 points comme ça on évite le redoublement

Tu refais le même papier avec juste des stats détaillées de la répartition d'emplois actuellement, une heuristique basique et conservative (même pas besoin de sondage, tu le fais toi même si tu veux) concernant les boulots qu'on peut accélérer avec ChatGPT, avec quelques exemple tiens (genre la traduction qui est assez indéniablement réalisable par ChatGPT assez correctement, jugé par un traducteur expert) et ça sera déjà plus intéressant

---

Genre le fait que y'ait une phrase sur le fait que le threshold "d'accéleration" de 50% est un threshold acceptable, puis découvrir à la fin que le chiffre de 50% fait partie du label m'a fait pété un câble.

Les mecs auraient pu mettre 30% ou 70% même résultat quoi, ça sort de nulle part et ils en discutent comme si c'était une variable qu'ils peuvent observer, c'est eux qui l'ont défini en premier lieu

-

21/03/2023, 17h11 #4420

L'interprétation la moins charitable en effet c'est que c'est pour faire flipper madame michu, dans un plan billard à 12 bandes histoire de contrôler la façon dont seront développées/régulées ces technos via l'opinion publique.

Tu peux même y rajouter que le truc a été rushé et c'est pour ça qu'il est nul, vu qu'Altman a donné deux ou trois interviews allant dans le même sens récemment donc ça semble intéressant de le sortir au même moment:

-

21/03/2023, 17h17 #4421Banni

Haha "we are a littble bit scared"

"Euh oui... malheureusement l'IA que nous avons développé est trop performante. Il va falloir légiférer à ce sujet parce que là je vous cache pas qu'on est sur une menace niveau Brainiac, oui Brainiac vous savez le méchant intelligent dans Superman. Ou Cortex si vous voulez, de Minus et Cortex. Je vous parle cerveau là.

Bref, ça nous fait peur, un truc aussi intelligent vous comprenez, on va tous être à la rue.

Après les abonnements démarrent à 0.80 pour 1000 tokens, voilà moi je dis ça, je dis rien."

-

21/03/2023, 17h40 #4422

Toutàfait ça. Surtout que y'en a pas mal qui leur en veulent pour la transition entre Open(source)AI et closed source, strictement non-profit à partiellement pour profit, etc.

Ils ont annoncé fermer une de leur API de génération de code y'a peu aussi. Ca sent pas mal le risque de plateforme si tu veux t'amuser à construire des produits par-dessus leur API, mais pour l'instant les alternatives sont un peu à la ramasse.

-

21/03/2023, 19h08 #4423

-

21/03/2023, 21h01 #4424

Bard, le ChatGPT de Google, a une liste d'attente public aux US/UK depuis aujourd'hui et pas mal de gens y ont déjà accès

-

22/03/2023, 00h11 #4425Grand maître du lien affilié

-

22/03/2023, 09h37 #4426

Pour éplucher la loi d'un point de vu général ça me paraissait pas mal sur le long terme.

(bon ça va pas nous pousser à faire simple )

"Les faits sont têtus."

)

"Les faits sont têtus."

-

22/03/2023, 12h20 #4427

-

22/03/2023, 13h49 #4428

Question : est-ce qu'il serait possible de modifier ChatGCP & compagnie pour garder entiérement son utilité, tout en y incluant dans toutes les réponse un espèce de "watermark" invisible pour l'utilisateur, qui permettrait néanmoins d'identifier à coup sûr son résultat comme une production articficielle (et permettant de savoir que le travail est le fruit d'une IA) ?

Réponse :

Pas de signature.

-

22/03/2023, 15h45 #4429

Je sais pas si c'est la même initiative mais OpenAI a également déclaré travailler sur un truc du genre, ça serait pas mal effectivement. J'aimerais bien des protocoles ouverts pour de la vérification d'identité aussi, sinon je vois pas comment certains réseaux sociaux vont survivre.

GitHub annonce étendre Copilot avec notamment un chatbot basé sur GPT-4. Chouette car je trouve l'autocomplete très efficace déjà, mais ChatGPT est capable de te générer bien plus large que ça comme des classes ou des composants entiers (y'a l'air d'avoir du transfert entre la capacité languagière étendu et écrire du code), donc pouvoir faire les deux

EDIT: source primaire: https://github.blog/2023-03-22-githu...er-experience/

-

22/03/2023, 18h29 #4430

Adobe Lance Firefly, une IA générative entraînée sur adobe stock et du libre de droits.

https://www.adobe.com/sensei/generative-ai/firefly.html

-

22/03/2023, 22h45 #4431Roxx0r

-

23/03/2023, 01h37 #4432

C'est surtout que les photographes ont été incité a mettre des images sur Adobe Stocks pour faire de l'argent de poche, vraiment de la monnaie de singe. C'etait Deja un mauvais plan

Et 8 ans plus tard, paf, ils se servent de toute ces photos pour ne plus avoir besoin d'eux, c'est plus que borderlineGrand maître du lien affilié

-

23/03/2023, 08h34 #4433Roxx0r

Photographes, illustrateurs, graphistes. On trouve aussi des vidéos que Adobe stock.

A l'heure actuelle,.je ne connais aucune IA générative grand public qui a joué les règles du jeu. Peut être en musique, faudrait que je regarde.

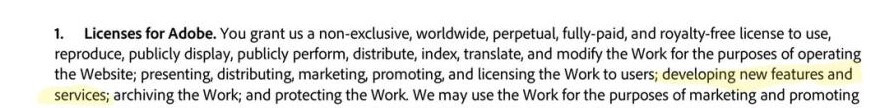

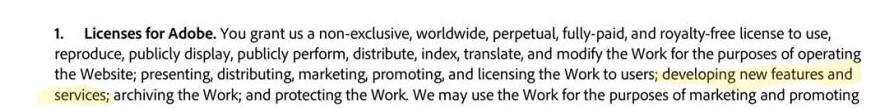

Et dans de plus en plus de termes and services pour les logiciels on voit arriver des clauses qui disent 'vous nous autorisez a entraîner des IA' (discord par exemple, si je dis pas de bêtises)

-

23/03/2023, 09h55 #4434Tyranaus0r

- Ville

- Bordeaux

J'imagine qu'au moment où tu déposais ton image, il y avait une licence qui était signée (OK, cliquée). Elle disait quoi?

J'imagine bien que c'est un truc que personne ne lisait, mais qui en gros disait que le site pouvait en faire ce qu'il voulait du moment qu'il te versait trois centimes de temps en temps. Je clique pareil (sans lire non plus) quand j'héberge des images pourries sur un site, mais en même temps j'espère pas en tirer de revenus et j'ai pas trop peur que l'hébergeur surexploite mes photos d'impressions 3D, ou de mon chien, ou de mes parties de wargames.

Ça va dans le sens d'une éducation de masse aux problématiques du numérique, et en particulier du droit du numérique. Que les jeunes de demain ne se fassent pas empapaouter comme les jeunes d'il y a 10 ans.

-

23/03/2023, 10h51 #4435Roxx0r

-

23/03/2023, 10h51 #4436Banni

J'ai tout vu Ze Pompom, tout

-

23/03/2023, 12h03 #4437

C'est une license super-large, j'ai du mal à voir comment tu fais pour imaginer que ça couvre pas entraîner un modèle génératif

J'ai pas trop de doute sur le fait qu'Adobe a déjà fait passer des couches et des couches de ML par dessus ces données pour d'autres raisons.

Ca m'aide pas à ne pas croire qu'en fait c'est pas un problème avec la légalité du truc mais juste avec le principe de l'IA générative.

-

23/03/2023, 13h01 #4438

Effectivement quand Adobe développait des outil d'IA pour ajouter des features comme le détourage automatique ou de la fusion de photo, personne ne mouftait.

Mais quoi qu'il en soit les photographes n'ont pas un problème de droit d'auteur dans ce cas précis, c'est plutôt le fait qu'ils se sont vendus pour 3 francs six sous.

Après, dans la mesure ou c'est pas la premiere IA générative et qu'ils auraient pu les entrainer sur n'importe quoi ...Grand maître du lien affilié

-

23/03/2023, 13h28 #4439Roxx0r

Il faut reconnaître qu'adobe fait au moins semblant d'avoir le droit,.même si je pense que les termes.of service ne couvrent pas l'usage qu'ils en font ( les clauses trop vagues et trop larges ça se fait jeter par les juges)

Pour s'entrainer comme les autres ben ils seraient là aussi hors la loi. Aucun des acteurs ne respecte la loi aujourd'hui (genre la convention de berne, ni même les directives et européennes sur le sujet.)

-

23/03/2023, 13h58 #4440

En même temps t'avais pas l'air très enjoué pour discord qui demandait la permission explicite non plus

Répondre avec citation

Répondre avec citation