Le nom du topic c'est pas cartes NVIDIATINTEL maintenant ?

Affichage des résultats 7 861 à 7 890 sur 9418

-

06/10/2022, 20h39 #7861

-

06/10/2022, 20h49 #7862Tyranaus0r

Manque AMD du coup, ATI fait un peu obsolète mais au moins ça marche toujours (j'avais mal lu). Et ils n'ont pas d'actu en ce moment… Ils seront sous les feux de la rampe dans un mois si j'ai bien suivi.

Malheureusement reste pas mal de taf à Intel, j'y croyais mais c'est pas gagné. J'espère que BabelTechReviews fera des benchs VR quand même, si ça ne déconne pas trop.

-

06/10/2022, 21h24 #7863

-

06/10/2022, 23h24 #7864

Après, les AMD sont actuellement bien meilleure en efficacité énergétique que les nVidia sur RDNA2/Ampère, et on pourra voir quand on aura la comparaison RDNA3/Ada, mais je doute que la tendance s'inverse.

-

07/10/2022, 09h02 #7865Hardc0re

Il y aurait une amélioration niveau qualité si des boîtes comme Amazon ou Google rachetaient Nvidia/intel/AMD?

-

07/10/2022, 09h18 #7866Tyranaus0r

Ça dépend s'ils essaient de les suivre avec du RT plus costaud et DL. Pour les benchmarks de base qui étaient leur force, ça ferait un poids mort.

Et selon s'ils règlent leurs cartes par défaut plus proche de l'efficacité ou de la perf max. Mais ça varie selon les modèles aussi.

J'aimerais bien qu'il y ait un mode économie facile à activer dans les drivers de toutes les cartes, de nos jours.

Mais selon mes mesures et ce que j'ai vu sur le matos mobile du type Steam Deck, plus on baisse la conso plus on gagne en efficacité, même s'il y a parfois des paliers plus ou moins bizarres. Généralement ceux qui regardent ça visent un point d'inflexion où ça se dégrade significativement plus, pas l'efficacité maximale absolue. Faut quand même que la carte donne des perfs, si c'est pour avoir le max de FPS/W à genre 20FPS/20W, ça ne sert pas à grand chose. Je ne sais pas trop comment ils équilibrent tous ces paramètres au design du matos. En tous cas j'ai jamais vu de puce réglée au point d'inflexion de base, c'est toujours beaucoup plus haut (sur ma GTX 1070 il est à ~100/150W sans tenter de faire d'équilibrage custom fréquence/tension).

-

07/10/2022, 11h40 #7867

Vu qu'on est à rumeurland, postons des prétendus leaks de bench synthétiques pour la "vraie" 4080 Alors ça reste une rumeur et ces benchmarks techniques n'ont pas grand intérêt mais si on suit la règle de 3 ça fait une carte 60% plus puissante que la 3080 (pour 70% plus de brouzoufs)

-

07/10/2022, 12h51 #7868

Ouais.

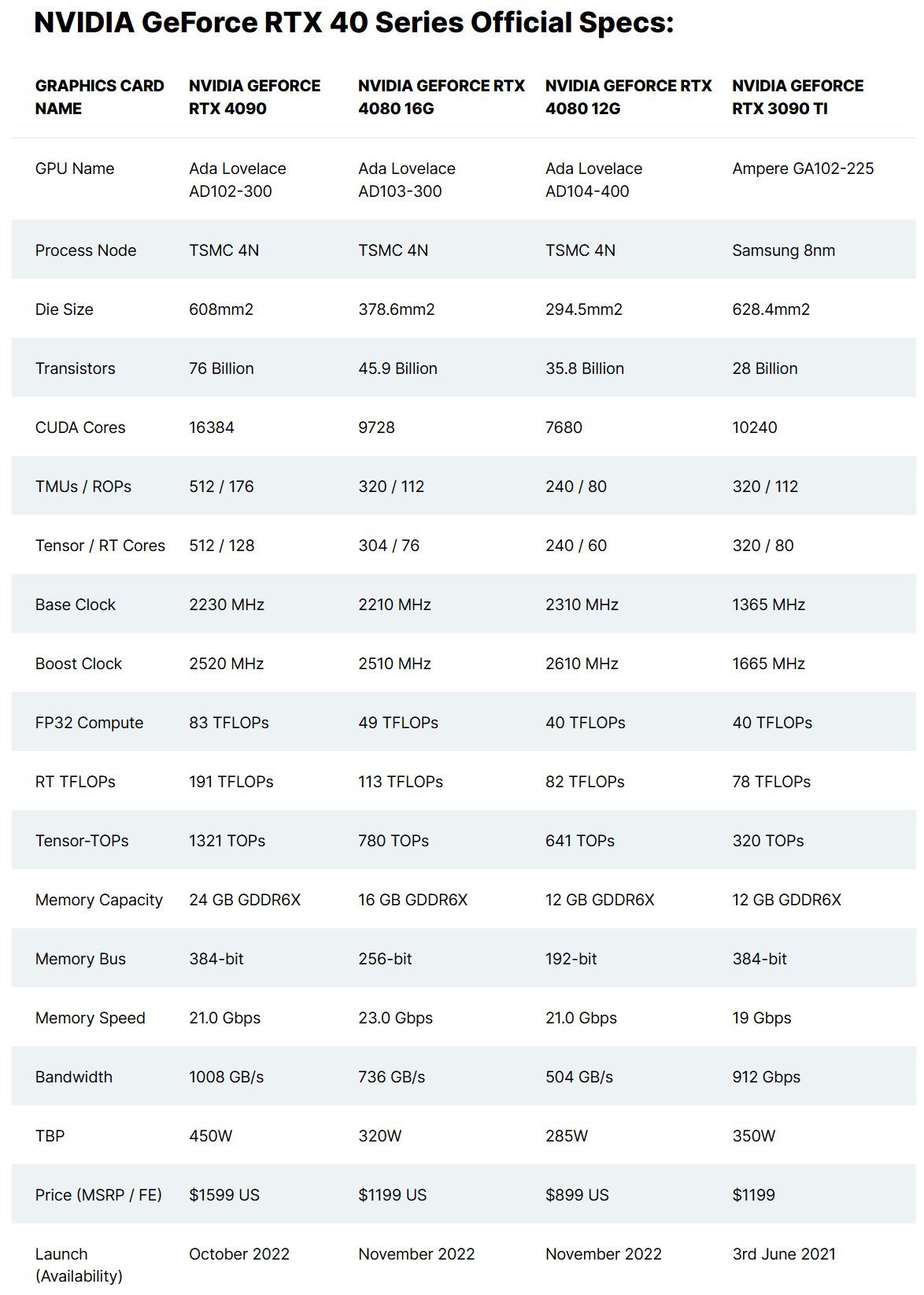

Gardez aussi à l'idée qu'il y aura 2 versions de la 4080 et que ça ne se limite pas qu'à la quantité de mémoire embarquée mais aussi aux nombres d'unités de calcul.

Vu les prix, c'est la 12Go qui devrait mieux se vendre et, je pense, avec des performances équivalentes (un poil supérieures) à la 3090 Ti.

-

07/10/2022, 13h14 #7869Tyranaus0r

Ils se sont planté dans le tableau, la 3090 a un TDP 350W et la 3090 Ti 450W. Ça m'a sauté aux yeux, pas vérifié le reste.

https://www.nvidia.com/en-eu/geforce...-3090ti/#specs

-

07/10/2022, 13h21 #7870

-

07/10/2022, 13h26 #7871Tyranaus0r

En fait c'est le titre qui est faux, c'est les specs de la RTX 3080 Ti.

https://www.nvidia.com/en-eu/geforce...x-3080-3080ti/

-

07/10/2022, 13h34 #7872

-

07/10/2022, 14h04 #7873

Est-ce qu'on sait quelles cartes AMD va sortir bientôt? C'est que des Léviathan ou y aura aussi des cartes type 7600x? Ils feraient très mal à NVIDIA s'ils sortaient le milieu de gamme bien avant eux pour une fois.

-

07/10/2022, 14h20 #7874

Elles seront annoncées début novembre. On sait qu'elles reposeront sur un design de type "chiplets" un peu comme les Ryzen, c'est à dire un GPU divisé en plusieurs modules et pas une grosse puce unique comme c'est normalement le cas. Pour AMD ça devrait permettre d'optimiser les coûts, à voir si ça se verra pour l'acheteur...

Dernière modification par Kimuji ; 07/10/2022 à 14h31.

-

07/10/2022, 14h32 #7875

Si on en reste sur la fréquence d'une puce uniquement (j'en ai parlé un peu dans le topic de l'undervolt

) le lien est directement proportionnel avec la tension.

) le lien est directement proportionnel avec la tension.

Et comme la puissance varie avec le carré de la tension, la fréquence suit le même chemin. Diviser la fréquence par deux, c'est potentiellement diviser la conso par 4.

Après l'exercice a quelques limites la carte ne va permettre d'utiliser qu'une certaine plage de tension, et la fréquence du GPU n'est pas totalement proportionnelle à la performance de rendu mais pas loin . En baissant la fréquence GPU mais pas celle de la mémoire (car la conso est assez anecdotique de ce côté) on a même un effet bénéfique où le GPU a proportionnellement moins de latence (en terme de cycles) si on baisse sa fréquence.

-

07/10/2022, 15h12 #7876

Chez AMD comme chez Nvidia, les cartes pour la plèbe (7700XT/4070 et moins) seraient prévues uniquement en début d'année prochaine. Pour l'instant on écoule les stocks de la génération précédente qui sont importants depuis la chute des cryptos. Là pour cette fin d'année chez AMD on aurait uniquement les 7900XT/7800XT.

-

07/10/2022, 15h25 #7877Hardc0re

Franchement ce ne serait pas intéressant vu qu'actuellement les nouvelles générations de cartes apportent des gains de performance peu importants, de passer des lois qui limiteraient la mise en vente des GPU jusqu'à ce qu'elles proposent un gain significatif? Par exemple dire à un instant T nous n'autorisons plus la mise en vente de nouveaux modèles jusqu'à ce que vous soyez en mesure de vendre un modèle apportant un gain de performance d'au moins 30 ou 40%?Quitte à avoir des années sans nouveau modèle,à charge aux sociétés de se débrouiller ou de reconvertir une partie de leur activité. Cela pourrait aller dans le sens d'encourager les gens à garder longtemps les mêmes cartes et ce ne serait plus la course aux performances dérisoires.

-

07/10/2022, 17h11 #7878Banni

- Ville

- expat

Ce qu'il faut pas lire ... Rien ne t'empêche de garder ta carte longtemps, je crois qu'Nvidia supporte toujours les Gtx600 qui ont environ 10 ans.

Plus l'évolution techno devient faible entre générations, moins tu renouvèle, mais plus les constructeurs vont te vendre des services.

Pour moi c'est clair qu'Nvidia vendra des features via Geforce experience, pas sur qu'on y gagne au change, mais pas sur qu'on y perde non plus

-

07/10/2022, 19h43 #7879Tyranaus0r

Ouais je me rappelle de ta réponse concernant l'undervolt, je suppose que le principe est de jouer sur la marge de tolérance.

J'ai fait des séries de test avec du simple power limit sur ma carte, faudrait que je fasse quelques stats et graphs pour mieux visualiser ce que ça donne dans la pratique.

Ça ne me semble pas si simple, et dans la pratique c'est une minorité qui va changer de matos si ça n'apporte pas grand chose. Puis probablement refiler l'ancien, ça ne sera pas perdu pour tout le monde.

Enfin ça me semble être du débat de société générique, ça marche avec tous les produits. Peut-être pour la discussion "refaire le monde" dans je ne sais quelle section du forum.Dernière modification par 564.3 ; 07/10/2022 à 19h57.

-

08/10/2022, 00h56 #7880reneyvaneGuest

Je ne veux pas te blesser mais on pourrait prendre le problème à l'envers, en quoi est-ce pour toi un sujet douloureux pour que tu en vienne à une telle solution ?

On a tous vécu le coup de se ruiner dans un gpu puis d'apprendre la sortie d'une Refresh mais ce dynamise de sortir fréquemment de nouvelle version à aussi pour but d'assurer des volumes de vente pour les partenaires, de corriger/perfectionner les nouveauté et d'élargir l'offre.

J'ai acheté une RTX2070 mono ventilateur qui chauffait, je l'ai revendu pour une RTX2070Super double ventilateurs qui était mieux refroidie puis je voulais prendre une 3080 mais ma tour de l'époque n'avait que 28.5 cm et elles n'existaient quand triple ventilation et j'ai trouvé la 3080Ti en deux ventilateurs qui mesure environ 27 cm.

La RTX2080Ti était la reine de la surchauffe avec sa GDDR6X, qui ont popularisé le watercooling, la 2080Super équipée de GDDR6 a permis d'avoir plutôt que d'attendre une vrai nouvelle architecture, un gpu assez proche ou le quidam n'avait pas à réaménager sa tour.Dernière modification par reneyvane ; 08/10/2022 à 14h21.

-

08/10/2022, 10h16 #7881

Sur les perfs, peu de chance, mais une loi sur la conso, ce serait possible.

Ca a été fait pour les TV, ce qui a mené à la mort des plasmas, techno avec les meilleures perfs, mais consommant trop. Depuis, d'autres technos les ont supplanté (déjà en cours avant la mort des plasmas, hein).

Une limite de conso pourrait être émise, mais elle n'empêcherait que le haut de gamme (ou le réserverait aux pros).

-

08/10/2022, 11h37 #7882

Vous sortez du sujet là. N’oubliez pas qu’on parle de puissance, vous oubliez le facteur temps dans votre raisonnement. Un joueur avec une carte de 350W qui joue 5h par semaine consomme 1,75 kWh pour son GPU en simplifiant. Celui qui a un GPU de 200W mais joue 20h par semaine consomme 4 kWh. De plus légiférer au niveau local quand les gens peuvent acheter sans un marché unique de dizaines de pays et qu’on représente une part infime des ventes mondiales, c’est profondément inutile.

Revenons au sujet plutôt que de sans cesse relancer de 10 sur les histoires de conso et de puissance des cartes, s’il vous plaît. Y’a d’autres sujets pour parler impact de l’informatique ou discuter au sens plus large du réchauffement climatique.

-

08/10/2022, 15h09 #7883Hardc0re

Comment se traduit un gain de performances sous 3dMark pour un joueur? D'après un article, la 4090 serait 82% plus rapide que la 3090 sous 3d Mark.Mais je 'ai aucune idée de la façon dont cela peut se traduire, si ça se confirme, dans un jeu.

https://www.hardwarecooking.fr/nvidi...0-sous-3dmark/

-

08/10/2022, 22h28 #7884

T'inquiètes, tu le sauras bientôt, les tests complets ne sont plus très loin.

-

10/10/2022, 18h59 #7885

-

10/10/2022, 19h19 #7886

A priori il va bien y l'y avoir de nouvelles RTX 3000 ...

Un peu comme ils avaient fais avec la RTX 2060 KO.Cordialement.

-

10/10/2022, 21h02 #7887Tyranaus0r

Les RTX 3000 Super pour les prolos, et les RTX 4000 pour les Jacques Séguéla en herbe

-

11/10/2022, 10h19 #7888

Va falloir prévenir Nvidia qu'ils roulent à contresens...

https://www.bfmtv.com/tech/gaming/tr...210070026.html

-

11/10/2022, 12h54 #7889Tyranaus0r

Leurs perfs par watt ont encore l'air de s'améliorer, même s'ils font des modèles très haut de gamme qui ne sont pas utiles à grand monde. Surtout si on règle le GPU de façon optimale, au pire ils peuvent toujours faire une update driver/firmware si les gens veulent que ce soit simple à régler.

Ce qui me gène plus c'est les GPU Intel qui ont l'air de consommer 40-50W quand on ne fait rien avec (idle et desktop). Mais pareil, faut espérer que ce sera patché.

-

11/10/2022, 13h14 #7890

Arg, on dirait que les AMD vont consommer autant que les Nvidia.

https://www.cowcotland.com/news/8355...-rtx-4090.html

Je ne garantis pas la non présence de bullshit dans ces graphiques...

Répondre avec citation

Répondre avec citation