Affichage des résultats 9 331 à 9 360 sur 10254

-

12/05/2021, 08h38 #9331Amateur de Petits-Gris

-

13/05/2021, 00h50 #9332

Yeah, je partage ton étonnement.

Éventuellement, les tests d'endurance étaient fais sur des SSD en SLC ou MLC (qui sont d'ailleurs allés plus loin que les specs), et les SSD qui ont récemment pris cher (si ce n'est pas une infox...) avec le minage seraient en TLC ou pire, en QLC ? Ca expliquerait en partie la différence d'endurance.

Ca plus l'interface : les vieux tests c'était en SATA, les débits séquentiels étaient bridés par l'interface. Les nouveau peut être en NVME, et si on imagine que ce sont des écritures séquentielles, ça doit écrire bcp bcp bcp plus vite qu'à la vieille époque.Dernière modification par gros_bidule ; 13/05/2021 à 01h00.

-

14/05/2021, 14h36 #9333

-

14/05/2021, 18h19 #9334

Oui tout à fait.

Et possible que les fameuses pannes de SSD ne soient qu'un simple calcul écriture théorique du minage vs capacités max théoriques du SSD d'après les specs. L'article ne donne pas d'infos précises (l'article cité comme source, c'est exactement le même mais en chinois, et le chinois ne cite pas grand chose autre que "un mec a dit que").

A mon humble avis, ce sont juste quelques andouilles qui essaient de faire le buzz ou de la spéculation. Ca n'ira pas plus loin, sinon ça aurait déjà explosé tous les compteurs.

-

15/05/2021, 11h50 #9335

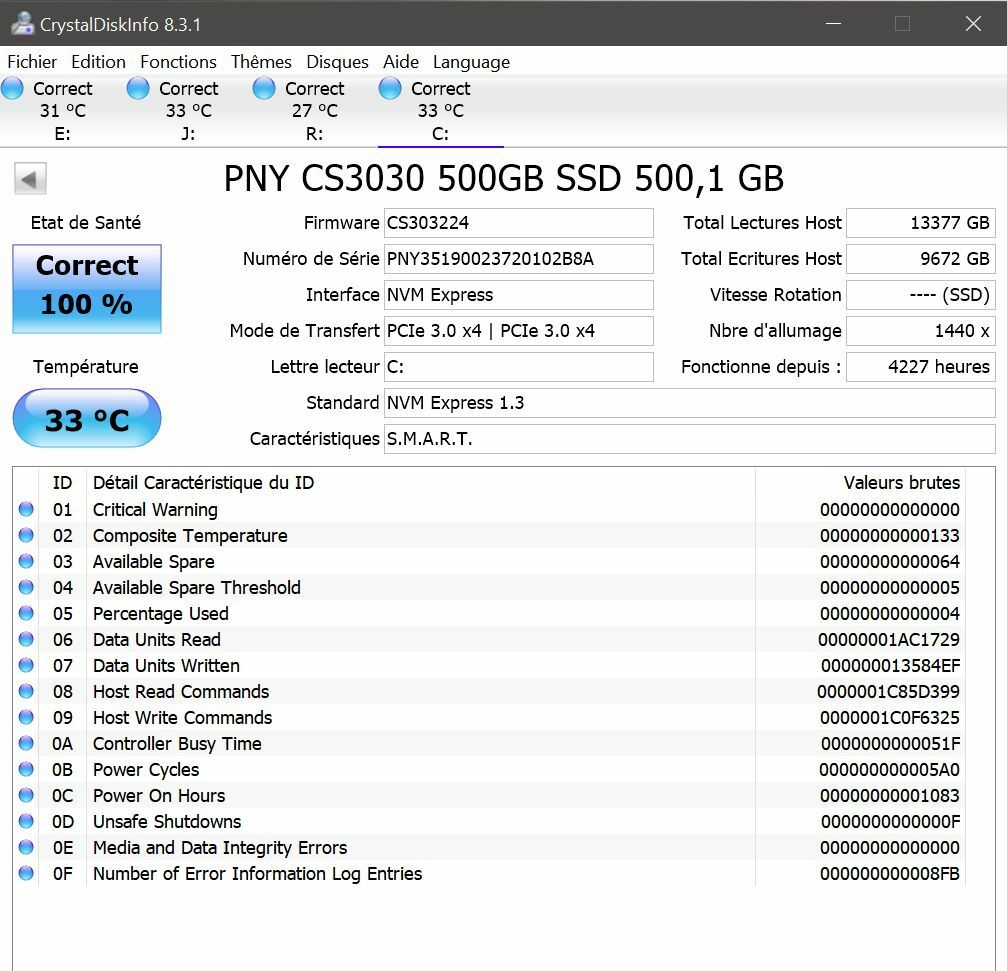

10To en 4227 heures, plutôt, non ? Soit 176 jours, et 0.057To/jour.

Si la moyenne se maintient à ces 57Go/jour, ce qui est en soit assez énorme* si on y pense, le calcul approximatif donne ~18 ans pour arriver à 380TBW.

Certes largement suffisant.

* si c'est un poste Wndows, le système et les applis écrivent beaucoup plus que les simples données issues d'une consultation internet. Logs, swap, restauration système, cache, indexation, fichiers temporaires...

-

15/05/2021, 12h36 #9336

Je vois ça par rapport aux jours d'usage, et ça fait 20 mois que le SSD est dans mon ordi.

Donc quand tu dis 57Go/ jour ce serait pour un ordi tournant 24h/24 "à fond dans son usage" or ce n'est pas le cas réel.

Après, je comprends très bien ce que tu dis, mais moi je fais une moyenne sur le temps.

Par exemple, j'ai acheté récemment un SSD de 1To (un BX500), j'ai copié un DD avec une partition Steam -> 525Go.

Si j'avais ramené ça aux 2 heures que ça m'a pris (oui, avec un DD qui pointe à 150 Mo/s en lecture et pas tout le temps c'est pas vraiment le SSD qui est limitant...), j'aurais pu dire que ce serait l'équivalent de 12*525Go en 12*2=24h !

Or, ce n'est pas l'usage réel...

-

15/05/2021, 12h49 #9337

Quand ton pc est éteint, ton SSD ne s'use pas. Si tu t'en sers 1h par jour, ça ne fait pas un jour (24h) d'utilisation effective.

La métrique de son usage réel, c'est la moyenne d'écritures par jour au regard du TBW (et de la garantie) annoncé par le fabricant.

Et comme toute moyenne, il faut suffisamment de données pour en tirer un valeur pertinente, sans même parler de lissage.

-

15/05/2021, 12h50 #9338

-

15/05/2021, 13h01 #9339

Si les paramètres SMART comptent en nombre de démarrages et nombre d'heures d'utilisation, il doit y avoir une raison.

Après, chacun est libre de calculer des trucs qui l'arrangent pour se rassurer. J'espère juste que tu ne bosses pas dans la maintenance d'un truc critique (moi non plus cela dit).

-

15/05/2021, 13h22 #9340

J'ai bien compris ce que tu as dit.

Simplement je vois par rapport à mon usage réel.

C'est vrai que je fais beaucoup de net, mais 50Go par jour ça me parait beaucoup, surtout que mes jeux sont "déportés" sur d'autres SSD.

Je soupçonne une grosse opération qui a fait monter la moyenne.

Enfin bon, j'ai tendance à changer de support principal au bout de 5-7 ans, donc même là je n'attendrais pas une limite de 14 ans.

-

15/05/2021, 13h59 #9341

-

15/05/2021, 15h06 #9342

S'il écrit en premier dans son cache SLC puis qu'il reporte discrètement tout ça sur la partie stockage conventionnel, ça pourrait déjà doubler la qté d'écritures. Du point de vue SSD.

Simple hypothèse.

Ca plus le travail de la zone d'over provisioning.

-

15/05/2021, 15h19 #9343

-

15/05/2021, 15h57 #9344

J'ai installé un logiciel qui permet de savoir combien on lit/ écrit de données à chaque lancement, on verra.

Mais je pense que comme dit Gros-bidule, il doit y avoir un effet démultiplicatif, je ne pense pas écrire autant.

-

15/05/2021, 19h04 #9345

Salut, je profite de la discussion pour apporter des infos.

J'ai 3 SSDs, 1 samsung 860 EVO de 500 Go pour le C:// (il a été mis à l'arrêt durant 6 mois pendant que j'utilisais le Kingston A2000 sur la 20H2 de Windows qui m'a posé énormément de problème. Depuis, il est mon C:// (à nouveau), mais pas pour longtemps, j'espère. Pour plus de détails sur ma life, voir le topic des bons plans ).

).

Ensuite, 1 SSD BX 500 de 960 Go qui me sert de D:// sur lequel, j'ai une partie des programmes et tous les jeux.

Et enfin un PNY qui me sert pour les captures vidéos et le boulot (copie locale pour le télétravail). Le PNY, on s'arrêté là, je n'ai pas de données quant à la quantité de donnée écrites (bizarre d'ailleurs).

Pour les deux autres :

Samsung : 3629 heures pour 7326 GB

Crucial BX 500 : 2072 pour 1406 GB.

Bon oui, le système écrit pas mal dessus

-

15/05/2021, 19h50 #9346

Je suis un peu au dessus quand même...

De mémoire, sur mes anciens Samsung 850, je devais être à 8-10Go par jour.

Je suis en train de regarder, j'ai trouvé un logiciel qui comptabilise les écritures.

- - - Mise à jour - - -

A priori, c'est Firefox qui écrit comme un goret...

-

15/05/2021, 20h16 #9347

>> https://sudonull.com/post/22400-Fire...-How-to-fix-it

Firefox...

-

15/05/2021, 20h36 #9348

-

15/05/2021, 20h41 #9349

J'ai installé AppReadWriteCounter:

https://www.nirsoft.net/utils/app_re...e_counter.html

Ca permet de voir les volumes.

-

15/05/2021, 20h59 #9350

-

16/05/2021, 10h24 #9351

Non mais la consommation de Firefox est hallucinante (voir le lien).

Comme je suis chez Sosh, je peux avoir accès via le portail Orange aux chaines de la télé (TNT).

J'ai mis le lien sous Edge, mais même là, le simple fait de regarder une chaine provoque un débit constant d'écriture de l'ordre du Mo/s....

Le mieux est encore de ne pas se servir de l'ordinateur...

-

16/05/2021, 14h16 #9352

Oui ça devient relou, sous prétexte qu'on a maintenant des capacités énormes sur nos PC, tous les softs/services prolifèrent en mémoire, échangent à gogo sur le réseau, lisent/écrivent sans cesse sur les disques...

-

16/05/2021, 15h11 #9353

Il faut raison garder tout de même, la situation n'est pas si sombre, plein de logiciels sont très raisonnables.

Edge qui écrit du Mo/s lors d'une vidéo, c'est normal (streaming, gestion des caches, etc...). Tu peux tout de même te renseigner pour savoir si tu peux déporter tout ça en RAM, avec le risque que ça augmente justement la conso mémoire ^^ (logique).

Pour Firefox, le soucis se pose lorsque vous demandez à restaurer les onglets ouverts lorsque vous relancez le navigateur. Si vous ne demandez pas cette restauration de session, ça va bcp mieux (et ça restaure qd même les onglets "épinglés").

Ce soucis de conso c'est pas une largesse, c'est un effet de bord d'une fonctionnalité. Tu veux être capable de restaurer ton FFox comme il était avant un crash, donc si tu veux récupérer son état de qques secondes (max 15s en l’occurrence) avant le crash (et pas 1h ou 1j), bah il faut bien sauver des choses. Ca gagnerait à être expliqué, même si pour le coup ça serait vite mal interprété et considéré comme anxiogène / mal codé, etc.

Bref, c'est pas évident, on ne peut pas avoir le beurre et l'argent du beurre. Si les devs avaient une solution, elle serait déjà en place.

-

16/05/2021, 17h49 #9354

-

16/05/2021, 21h07 #9355

Oui tout à fait, on a de la marge.

Perso, ça m'a fait réaliser que je n'utilisais jamais la restauration de session, ce qui m'intéresse est déjà "pinné", donc c'est tout bénef si je vire ce truc qui écrit finalement pour rien (dans mon cas).

-

16/05/2021, 21h08 #9356

Raisonnables ?

J'ai pris le solft linké plus haut, Bitdefender a lu 4 Go et en a écrit 2, en 1/2 journée

Overwatch a lu 14Go en 2h (mais écrit quasi rien).

(mais écrit quasi rien).

-

16/05/2021, 21h33 #9357

Il me semble dommage de descendre toute la classe parce qu'il y a 2 hurluberlues qui sèchent les cours

Des logiciels, il y en a à foison.

Des logiciels, il y en a à foison.

Aussi, la critique n'est pas si évidente. Prenons le cas de l'antivirus : ok, il a "bcp" écrit, mais quoi et dans quel contexte ? S'il agit comme intermédiaire lorsque tu télécharges des fichiers, il est peut être normal qu'il écrive, mais il le fait au nom d'un autre logiciel.

Ca serait comme reprocher à un logiciel de gestion de téléchargement de consommer du débit internet ^^. Nan mais allô la police.

Peut être aussi ton antivirus fait partie d'une suite logicielle, comme ça se fait de plus en plus, et qu'il y a un module de sauvegarde qui sauvegarde des trucs ?

Overwatch qui lit 14Go en 2h, c'est juste le chargement des maps (de mémoire, le jeu fait 30Go ?) Regardes ce que fait un gros jeu comme Cyberpunk en mode 4K, je parie ce que tu veux que ça explose tous les compteurs de lecture. A côté, le bitcoin c'est des éoliennes.

Regardes ce que fait un gros jeu comme Cyberpunk en mode 4K, je parie ce que tu veux que ça explose tous les compteurs de lecture. A côté, le bitcoin c'est des éoliennes.

Après oui, il y a de mauvais élèves. Prends par ex certains jeux de course Codemasters : par défaut, même si tu ne gardes aucun "replay" de tes courses, tu as toujours un fichier de replay de plusieurs Go dans "C:/ProgramData/chéplusquoi/". Là oui, c'est le bon gros segpa du jeu vidéo. Débile. Et du coup, si vous avez un petit SSD, pensez à ProgramData pour faire peut être de la place, car désinstaller le jeu ne nettoie pas ce fichier de replay.Dernière modification par gros_bidule ; 16/05/2021 à 23h08.

-

17/05/2021, 08h23 #9358

Le problème c'est qu'on s'attendrait, pour certains usages, à utiliser de la RAM avant de passer par l'écriture sur le support.

Dans le cas d'une lecture vidéo, quelques infos périodiques sauvegardées suffiraient.

- - - Mise à jour - - -

La lecture c'est pas grave, c'est bien l'écriture qui bouffe des états.

-

18/05/2021, 10h08 #9359

Je viens de mettre le logiciel que tu as mis en lien et grosse surprise. En lecture, les plus gros mangeurs sont ceux qui ne sont pas lancés

En écriture, il est vrai que Firefox sort du lot. Pour info, j'ai opéra et Edge également ouvert ainsi que Thunderbird.

En écriture, il est vrai que Firefox sort du lot. Pour info, j'ai opéra et Edge également ouvert ainsi que Thunderbird.

Opéra qui a le plus d'onglet d'ouvert et sur lequel j'écris le présent message et très très très loin derrière en écriture.

-

18/05/2021, 10h43 #9360

Répondre avec citation

Répondre avec citation