Bah avec ton adaptateur mini pcie vers pcie x1, ce sera aussi du bricolage, ça passera jamais dans un nuc ou autre petite carte

Je pense qu'il te faudrait directement partir sur un petit pc mini itx, tout rentrerait dedans facilement et il n'y aurait qu'une seule alimentation ^^

Il existe des cartes mères avec processeurs intégrés en mini itx avec port sata et port pcie x1, tu mets ça dans un boitier de moins de 10l avec alim intégré aussi et tu pourras y mettre ta carte vidéo et ton disque dur sans soucis

Par ex.

https://shop.hardware.fr/fiche/AR201404170017.html

https://shop.hardware.fr/fiche/AR201610240036.html

Dans un boitier tel

https://shop.hardware.fr/fiche/AR201405070096.html

https://shop.hardware.fr/fiche/AR201501150011.html

https://shop.hardware.fr/fiche/AR201610040049.html

Les solution en carte mère micro atx sont un peu moins chères mais les boîtiers sont plus gros et au final reviennent plus chers que les boîtiers mini itx

Affichage des résultats 8 851 à 8 880 sur 11151

-

23/10/2017, 19h50 #8851

-

29/10/2017, 12h42 #8852

Salut à vous les canards.

Ne souhaitant pas polluer le topic avec un nouveau sujet qui n'est pas si indispensable pour le moment, je me permet de poster mes questions ici

Propriétaire d'un i5 3570k (non oc) (plus gtx 1070, très récente alim seasonic 520w, 2 ssd et 1 hdd) qui me convient encore pleinement, je regarde un peu les composants pour une future mise à jour (surtout en cas de bonne affaire niveau prix)

Sachant que mon utilisation serait surtout jeu/bureautique je ne pense pas partir vers un upgrade démesuré. A savoir :

2*8 gigas ddr4 2666 https://www.amazon.co.uk/gp/product/...KL5A1OLE&psc=1

Ryzen 5 1600 https://www.amazon.co.uk/gp/product/...1SGSPLH4&psc=1

CM Gigabyte ab350m https://www.amazon.it/gp/product/B06...PNWYJU7H&psc=1

Les liens sont ceux d'amazon italie car les prix sont les moins chers de tout le réseau amazon europe mais une autre boutique n'est pas à exclure.

L'upgrade est t'il cohérent ? Faut t'il acheter une pâte thermique supplémentaire ? Ces offres via ebay pour un windows 10 sont t'elles valables ? http://www.ebay.fr/itm/CLE-ORIGINAL-...8AAOSwol5YzsmV

Je souhaiterais aussi repartir sur une install absolument fraiche (c'est à dire mes 3 diques durs formatés complètement) Si j'ai bien compris, je peux formater mes deux disques ne possédant pas windows avec un logiciel style ccleaner ? et le disque contenant windows se formatera au moment de l'installation de windows 10 ?

Merci d'avance pour vos réponses

Dernière modification par Yemmeth ; 29/10/2017 à 13h08.

-

29/10/2017, 15h34 #8853

Pour du gaming, ton i5 overclockable est encore dans le coup. S’il est limitant, alors tu peux l’OC sans soucis.

Un R5 1600 ne te fera qu’un gain de 20/25% par rapport à ton i5.

http://www.hardware.fr/articles/965-...s-jeux-3d.html

-

30/10/2017, 13h33 #8854

Coin!

Je suis un peu largué niveau hardware, au niveau de la ram je voulais savoir quel était la quantité nécessaire environ pour les jeux actuels?

J'ai 8go de ddr3 pour l'instant, avec un i5 4690k je crois et une ati r290x. Bref je voulais racheter 8go, 16go au total seront nécessaire ou bien pour l'avenir il faudra envisager plus? Sachant que je ne fais pas de montage vidéo/photo et que j’espère conserver mon pc encore 4/5 ans.

Merci

-

30/10/2017, 15h49 #8855

Salut,

Ta config actuelle est équilibrée, mais vieillissante. Ton i5 n'est pas encore largué mais il date, et aujourd'hui la norme (en 2017) c'est 6 cœurs pour un CPU de joueur. Ça veut dire que les futurs jeux risquent d'être limités par 4 cœurs (ça marchera toujours, mais moins rapidement). De plus l'architecture de ton processeur n'est plus au top et les nouveaux CPUs font mieux (de l'ordre de 20% plus rapide à fréquence égale).

Tout ceci fait que ton processeur, à mon humble avis, ne fera pas encore 4 ou 5 ans si tu comptes jouer à toutes les nouveautés dans un confort absolu. Dès lors, pourquoi upgrader la RAM et dépenser de l'argent pour de la DDR3 aujourd'hui chère alors qu'une upgrade totale va bientôt s'imposer, avec passage sur de la DDR4? Je ne te le conseille pas.

Économise tes sous en vue d'une upgrade de ta plateforme (mobo/CPU/ram) d'ici 1 an environ. De même ta R9 290X pourrait être remplacée si jamais tu trouves, aujourd'hui, qu'elle te force à faire trop de compromis dans les réglages.

-

30/10/2017, 16h17 #8856Banni

- Ville

- Trévoux

-

30/10/2017, 16h22 #8857

Je parle de norme sur une config de 2017. Prend n'importe quelle config de joueur à 1000€ aujourd'hui et on va te recommander un Ryzen 5 ou un i5 Coffee (s'ils sont dispos). Bien sûr que t'as une inertie et qu'il faudra des années avant que les 6 coeurs ne deviennent majoritaires parmi les joueurs, mais 2017 sera l'année où ça commencera à évoluer. Dès lors dire "je veux garder mon quad-core qui a déjà 3 ans pendant encore 4 ou 5", je dis que je ne sais pas si c'est aussi sûr que ça. D'autant que côté écrans aussi la mode évolue pour s'éloigner du bon vieux 1080p 60Hz, et que dès qu'on parle de 120 ou 144Hz le CPU devient soudainement beaucoup plus limitant.

-

30/10/2017, 18h27 #8858

-

30/10/2017, 18h46 #8859

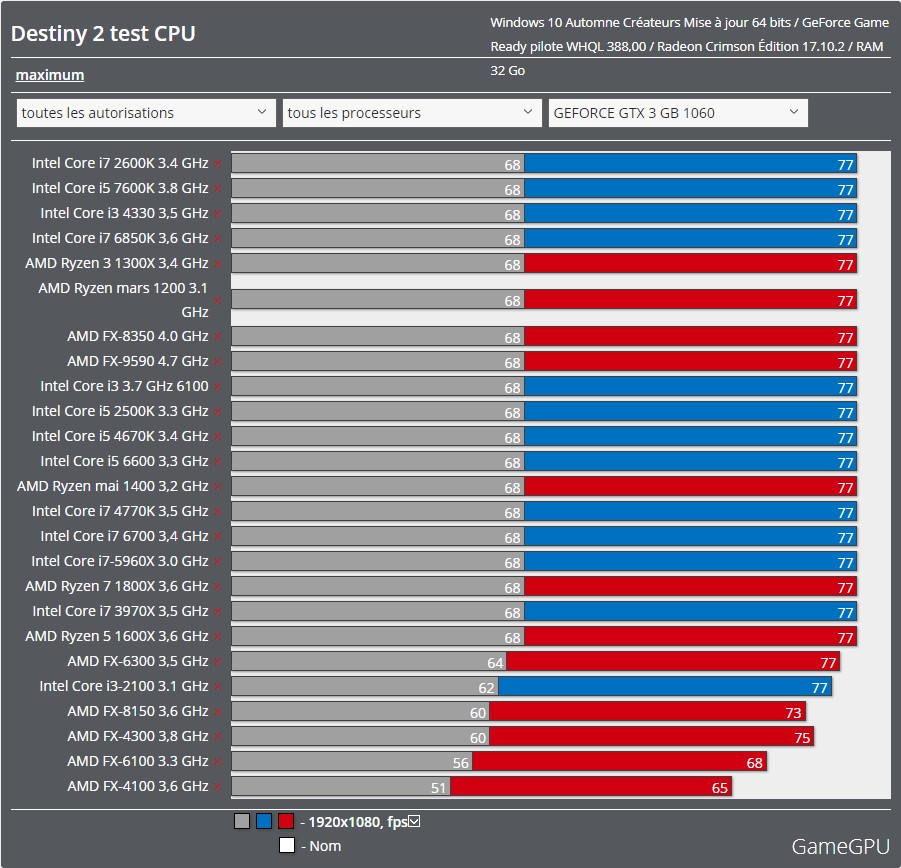

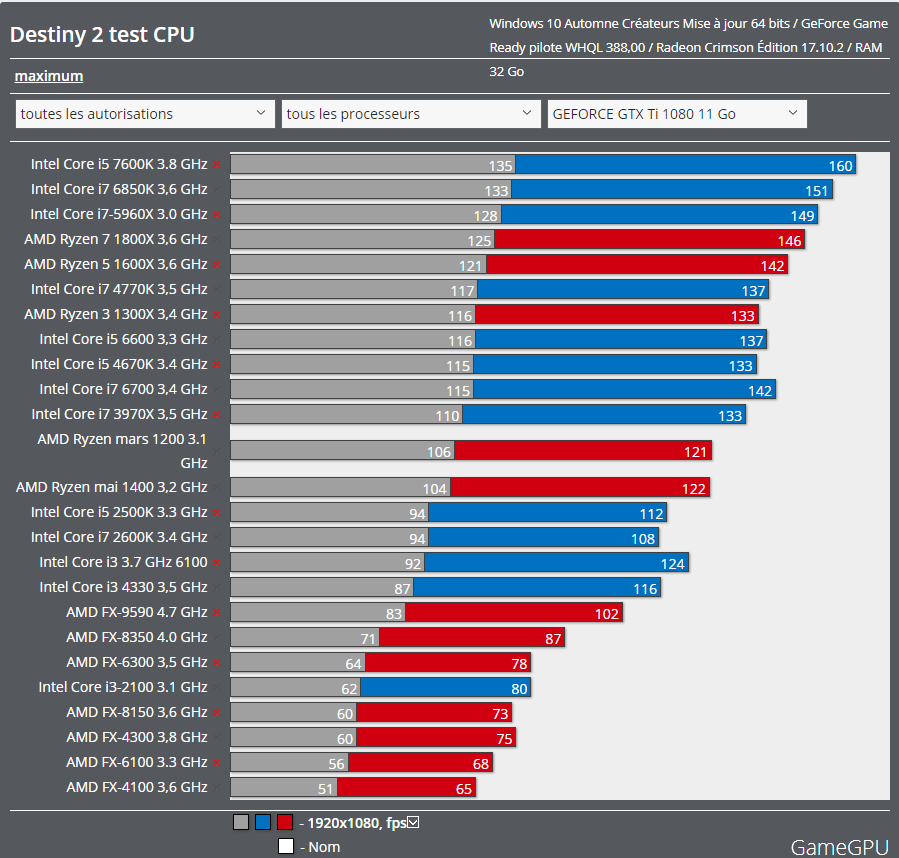

Suffit de prendre un perf test de jeu qui soit bien optimisé côté CPU (j'entends par là un jeu tirant vraiment au maximum parti du CPU disponible) et gourmand en physique. J'ai trouvé Destiny 2 par exemple, c'est pris au hasard:

Comme on le voit sur ce graphique, n'importe quel processeur est capable d'assurer 60fps au moins avec une GTX1060 3GB: c'est bien la carte graphique qui limite les performances. Donc si tu joues en 1080p 60Hz, tout va bien quelque soit ton CPU.

Maintenant admettons que tu aies changé ta carte graphique et ton écran et que tu veuilles jouer en 144Hz: il se passe quoi?

Soudainement le CPU devient un élément prépondérant et ce n'est plus le GPU qui dicte. Et si tu as un i5-2500K dans ce scénario, on voit bien que tu perds 40fps (au mini) par rapport à un i5-7600K.

Voilà pourquoi je dis qu'un CPU n'est pas limitant si tu vises les 60fps (60Hz avec Vsync on) car pratiquement tous y arrivent dans les jeux modernes, mais que dès qu'on vise 120 ou 144Hz la rapidité du CPU est tout aussi importante que celle du GPU, et on ne peut plus se contenter d'un processeur un peu âgé et avec un déficit de MHz.

C'est un truc facile à tester dans mon cas aussi: mon Ivy Bridge plafonne à 3,5GHz et ça me bride parfois sur mon écran 144Hz. Même en baissant les détails il arrive un moment où le CPU plafonne et m'empêche d'avoir plus de FPS, limitation que seul un changement de CPU me permettrait d'éviter. En pratique je m'en tape, bien sûr, parce que je suis un joueur casual qui n'utilise pas de compteur de FPS et utilise de toute manière Freesync, mais ça n'empêche que la limitation existe.

-

30/10/2017, 20h39 #8860

Merci pour cette explication.

En effet, la limitation est clairement possible. Au delà du gars qui prends une 1060 GTX 6 Go et qui met tous les paramètres au minimum (j'ai le cas d'un collègue), sur du 1080p, même avec un i5 6600K, tu seras CPU limited en 144 Hz (son cas d'ailleurs).

Pour moi, ces réglages ne sont clairement pas adaptés. J'ai bien compris qu'il veut avoir le max de FPS sur Crysis 3 (gourmand niveau CPU pour du FPS), mais ça dénature un peu l'utilité d'avoir un PC et pas une console avec des graphiques franchement délavés et je le dis, car je l'ai testé Certes une console c'est limité à 30 fps de mémoire, mais bon je trouve dommage de sacrifier autant les graphs, mais c'est perso après.

Certes une console c'est limité à 30 fps de mémoire, mais bon je trouve dommage de sacrifier autant les graphs, mais c'est perso après.

Je préfère perdre un peu de framerate, mon choix, pour avoir un rendu un peu meilleur.

Maintenant, il faut aussi voir, j'en fais partie, qu'il y a de plus en plus de monde qui aime faire de la capture vidéo pendant le jeu pour montrer les skills aux potes ou aux non joueurs Du genre, comment c'est du multi en ligne ?? Rien de tél qu'une petite vidéo pour y répondre.

Du genre, comment c'est du multi en ligne ?? Rien de tél qu'une petite vidéo pour y répondre.

Du coup, le choix d'un 144 hz est clairement difficile. Cela offre un confort, d'après ce qu'on a pu me dire, pour les skills franchement appréciable. Mais bon, tenir les 144 Hz en 1440 p semble chaud sans démonter le compte en banque au delà du prix de l'écran lui-même

Encore merci pour l'explication.

Je retiens, grosso modo, pour du 144 Hz prendre CPU haut de gamme et avec une fréquence élevée de préférence of course.

-

30/10/2017, 20h51 #8861

-

31/10/2017, 11h39 #8862

-

31/10/2017, 11h43 #8863

Je dirai Firefox ou Chrome

http://gamegpu.com/

http://gamegpu.com/action-/-fps-/-tp...2-test-gpu-cpu

-

31/10/2017, 11h44 #8864

GameGPU.ru. Une mine de benchmarks des jeux, GPU et CPU. A ma connaissance leur méthodologie n'a jamais été remise en cause, donc je me base sur eux (entre autres).

-

31/10/2017, 12h45 #8865

Wouah j'avais oublié que l'informatique évoluais aussi vite

Mon pc d'avant je l'ai gardé quasi 8 ans en changeant juste la cg, j’espère faire pareil avec celui-la. Bien entendu avec les années je serais obligé de bien baisser les graphismes, mais je joue qu'en 1080p 60hz, pas envie de changer non plus pour les prochaines années.

Mon proc je vais l'OC au max, ca devrais le faire pour quelques mois, pour l'instant je suis TAF sur les derniers jeux (enfin ça doit être battlefield 1 le plus récent que j'ai lancé), mais du coup 16go de ram ca va pas changer grand chose dans les jeux? Je vais bientôt me lancer dans heart of iron 4 qui bouffe pas mal de ressource apparemment.

Apres en quantité égal, on voit vraiment une différence entre de la ddr3 et ddr4?

-

31/10/2017, 13h37 #8866

Si tu es en 1080p 60Hz ton CPU est encore large. Il le sera pour un moment tant que tu ne changes pas d'écran pour un modèle 144Hz. Inutile de l'OC tant que les performances sont déjà à fond, tu vas consommer/chauffer plus - pour rien!

La RAM je confirme qu'en dehors d'un ou deux jeux ça ne sert à rien d'avoir plus de 8GB. Vérifie les performance tests de HoI 4 et surtout la conso de RAM en 1080p, ça m'étonnerait que tu dépasses les 4 à 5GB de RAM utilisés. En plus les tarifs sont très élevés en ce moment, c'est un mauvais moment pour en acheter.

Il n'y a pas de différence de perf entre DDR3 et DDR4, seule la conso a évolué (et la latence, en moins bien).

-

31/10/2017, 13h52 #8867

Ok merci. Pour la conso de ram je vais simplement dans le gestionnaire de tache? Et dans HoI4 il y a un benchmark?

La latence est moins efficace sur la ddr4, c'est un peu bête ça

Je vous tiens au courant de tout ça, je vais garder ma tune pour l'instant, enfin la dépenser ailleurs au final

-

31/10/2017, 14h55 #8868

Oui, tu lances le jeu en laissant le gestionnaire de tâches, onglet Performance, tourner en fond. Ca te montrera la consommation de la RAM, du CPU, etc. de façon dynamique et avec l'historique (pas besoin d'alt-tab, tu checkes une fois que t'es sorti du jeu). A priori vu la config recommandée du jeu (i5 2,6GHz et 4GB de ram) tu es très large avec ta config actuelle.

En général s'il existe des benchs tu les as sur google en cherchant "performance test" + le nom du jeu. Sauf que là j'ai rien trouvé.

-

31/10/2017, 15h55 #8869

-

31/10/2017, 18h35 #8870

Je viens d'installer une P8P67 + i5 2500K + 2*4 gigas de RAM. L'ordinateur démarrait (ventilateurs qui tournent) mais atteignait le POST environ 1 fois sur 4. Je soupçonnais une histoire de RAM alors j'ai voulu essayer chaque barrette sur chacun des emplacements. Je n'avais pas fini les tests que le ventirad s'est mis à faire un bruit de réacteur. Maintenant, à l'allumage, les ventilateurs tournent encore (et le ventirad est toujours à fond) mais pas moyen d'aller plus loin, même la LED sur l'état de la RAM ne s'allume plus (grillée ?). Avant de me lancer dans le démontage, il y a d'autres pistes à explorer ?

Dernière modification par DeadFish ; 31/10/2017 à 19h29.

-

01/11/2017, 09h26 #8871Banni

- Ville

- Anis

Là comme ça, ça pourrait être plein de choses:

-la ram comme tu le soupçonnais

-l'alimentation (sait-on jamais)

-la carte mère qui se meurt

Pas de diagnostic miracle, il va falloir tout tester.

-

02/11/2017, 00h25 #8872Z'oeuf

- Ville

- Chantilly

Salut dalgwen,

Tu peux jeter un œil au LattePanda : Atom avec Win10 intégré et Arduino en prime.

Plus d'infos ici (en anglais, sous-titré si tu cliques sur l'option en bas à droite) : https://www.youtube.com/watch?v=z5EXNfHYPfQ

Have fun

Baervar

-

04/11/2017, 12h51 #8873

Bon, j'ai rien trouvé de mon côté alors j'ai ramené tout le bazar à l'atelier Matériel.net et il semblerait que la carte-mère soit HS (une piste du circuit imprimé est à nu, il y a un peut-être un rapport). Alors je regarde ce qui se fait niveau processeur et je suis un peu perdu entre les Ryzen, les nouveaux Intel qui ne sont pas vraiment nouveaux mais en fait si, etc. J'ai pas vraiment de budget, je pourrais partir sur un i5 8600K top moumoute mais étant donné que je tourne avec un Athlon II depuis des siècles et que je me sens limité que depuis l'année dernière, je me dis que ce serait un peu overkill. Donc je fais quoi ?

- - - Updated - - -

Ma carte graphique est une 770 et l'alimentation une LDLC 550W. Je joue sur un écran 1080p 60Hz.

-

04/11/2017, 13h59 #8874

Bah disons qu'avec un i5 8600k, tu tiendrais autant de temps qu'avec ton Athlon II mais si c'est pour rester sur du 1080p 60hz, oui il est un peu overkill, le i3 8100 suffirait mais il faudra attendre des cartes mères compatibles moins chères, pas besoin d'une Z370 pour ce processeur, les B360 sont prévues pour l'année prochaine me semble...

-

08/11/2017, 13h06 #8875

Je pense à mettre à jour ma config un de ces quatre. J'ai actuellement un i5 2400, une GTX 770 et 8Go de ram et j'envisage de passer sur une GTX 1070 TI (et donc nouveau CPU, CM et ram). Je pensais au départ seulement acheter ce dont j'ai besoin et réutiliser tout le matos qu'il me reste (Boîtier Fractal R4, un ventirad Arctic Freezer 13, un Crucial MX100 256 Go + deux dd) mais je me demande si ça ne serait pas plus facile de revendre le pc complet ou presque et me refaire un pc de zero. D'où ma question : ça se vend bien et vite les pièces détachés (ici ou sur le bon coin) ou autant vendre le tout ?

-

08/11/2017, 13h58 #8876

Après tout dépend ton budget aussi

Tu peux garder tout ton stockage comme tu peux garder ta CM et ta ram, en changeant juste le cpu pour un i7 3770(K), ça devrait être ça le max de ta CM mais à vérifier tout de même et il fera tourner la 1070Ti

-

08/11/2017, 14h51 #8877

Pour la revente, à moins d'avoir déjà un client t'auras plus de mal à le vendre complet qu'en pièces. Et surtout tu en tireras probablement nettement moins. Un vieux PC de joueur n'intéresse pas grand monde, ou alors à petit prix.

J'aime bien la suggestion de Stiouf, si le i7-3770K passe sur ta mobo et que celle-ci permet l'overclocking (modèle Z) t'es sûr d'avoir aucune limitation CPU et ça te coûtera infiniment moins cher qu'un ensemble CPU/mobo/ram moderne (indice: 200€ Ryzen 1600, 100€ mobo, 200€ les 16GB de DDR4, donc 500€ hors promo).

-

08/11/2017, 15h18 #8878

Merci pour les réponses rapides. Je ne n'avais pas penser à cette option, j'étais partit du principe que ces composants étaient obsolètes. Je n'ai pas la référence de la carte mère sous la main mais elle ne permet pas l'overclock en tout cas. Ça reste intéressant ?

-

08/11/2017, 15h28 #8879

Un i7-3770 non-K (ou K mais pas overclocké) resterait 25% plus rapide en jeux que ton i5-2400 (source). Alors oui, un nouveau i5-8600K sera encore un peu meilleur (60% meilleur que ton CPU) mais en pratique il est:

- introuvable

- beaucoup plus cher vu qu'il faut tout changer

- difficile d'avoir réellement 60% de FPS en plus car ce n'est mesurable qu'en situation où le GPU n'est pas limitant, autrement dit en 1280x720...

En clair: les situations où un i5-2400 va limiter une GTX1070Ti existent et risquent de se rencontrer assez fréquemment, sauf si tu comptes jouer en 4K (plus la définition de jeu est élevée, plus c'est le GPU qui trime). A l'inverse les 25% de puissance supplémentaire du i7-3770(K) en font un bon candidat car c'est une upgrade raisonnable en prix, et ces 25% vont se sentir. Ensuite passer d'un i7-3770(K) à une plateforme moderne va coûter beaucoup plus, sans que les situations où tu vas en profiter ne soient si fréquentes que ça.

Le fait que tu ne puisses pas OC est dommage, mais pas dramatique. Le 3770(K) a déjà une fréquence de base bien plus élevée que ton processeur actuel.

-

08/11/2017, 19h58 #8880

C'est dommage il n'a plus l'air trouvable en neuf. Il est autour de 100€ sur le bon coin mais pas du tout de mon coté.

Il y a autre chose que le socket à regarder pour le compatibilité cm/cpu ? Sur LDLC il y a pas mal de CPU pour socket 1151 (on est bien d'accord qu'ils sont compatible 1155 ?) comme le I5-7500 (+23% de perf) voir le i7-7700 (qui serait overkill vu le reste de la config ?).

J'ai une Z68AP-D3 en cm.

Répondre avec citation

Répondre avec citation