Ouais, "plutôt pas mal"(je trouve ça magnifique perso)

Affichage des résultats 2 281 à 2 310 sur 2349

Discussion: Un titre rigolo pour des images générées par IA

-

10/03/2024, 18h40 #2281

-

10/03/2024, 19h19 #2282

Du coup je me demande si c'est encore vrai que Midjourney "défloute" avec la v6, si il arrive à faire correspondre changement de couleur et bon alignement des pixels.

Ou alors il y a un "post-processing" qui se charge de ça sur la dernière couche de défloutage.

-

14/03/2024, 11h33 #2283

Hey.

Hey.

Depuis quand Midjourney comprend le français ?

Mal réveillé, je clique sur l'onglet Discord, je fais "/i", choisit le premier choix et .... en pensant à autre chose tape le prompt en français... Et le résultat est ce que je demande

Sinon ça me fait ça un peu trop souvent à mon goût récemment :

Vous aussi ?

- - - Mise à jour - - -

Nan mais c'est méga relou en fait

Emission de radio Friday Rocks sur Radio Sud Manche : ici

Emission de radio Friday Rocks sur Radio Sud Manche : ici

Ma page de memes : AutisteReddingPhotoshops

-

14/03/2024, 19h07 #2284

Le Français ? Depuis toujours. C'était même un moyen de contourner certains filtres pendant un moment. (mais si on en abusait pas, on se faisait pas allumer derrière).

-

14/03/2024, 19h43 #2285

Purée... impossible de me souvenir pourquoi mais j'étais persuadé qu'il ne prenait pas en compte d'autres langues... hahaha...

Emission de radio Friday Rocks sur Radio Sud Manche : ici

Ma page de memes : AutisteReddingPhotoshops

-

14/03/2024, 19h45 #2286

Vu qu'ils ratissent large sur les données liées aux images récupérées sur Internet, c'est normal qu'il y ait aussi du français. Il doit aussi y avoir du chinois, du turc, etc. Mais il y a quand même des chances qu'il "comprenne" mieux l'anglais, puisqu'il y a probablement le plus de données d'entraînement dans cette langue.

-

14/03/2024, 21h58 #2287

J'ai testé le Chat, le ChatGPT de Mistral.AI.

Je lui ai demandé un dessin en ASCII art, il y va cash :

(et les accents à la fin font bugguer la sortie, il boucle à ajouter et supprimer des caractères, je n'arrive pas à reprendre la main...)

-

14/03/2024, 23h26 #2288

Alors tu demandes un dessin en ASCII art à l'IA et elle te dessine une bite...

Je crois que l'IA devient beaucoup trop humaine...

-

15/03/2024, 00h04 #2289

Et un chat avec une queue qui bouge.

Le Chat est un obsédé sexuel. L'IA à la française, messieurs dames !

-

15/03/2024, 00h23 #2290

C'est l'IA gauloise.

-

15/03/2024, 00h32 #2291

-

25/03/2024, 20h55 #2292

https://player.vimeo.com/video/926365659?h=6b492b0354

https://player.vimeo.com/video/926361712?h=c09915698c

Quelques vidéos faites avec Sora (+ montage), l'IA génératrice vidéo d'OpenAI.

https://openai.com/blog/sora-first-impressions

-

25/03/2024, 21h18 #2293

Hum...

Je risque de plonger dans ce truc, c'est vrai que c'est un medium qui va permettre de montrer de nouvelles choses (sans avoir un budget hollywoodien).

-

25/03/2024, 21h19 #2294

C'est exactement ce que je me disais. Des gens talentueux vont pouvoir créer des choses bien cools avec un budget minime

Mais ça reste flippant comme meme Emission de radio Friday Rocks sur Radio Sud Manche : ici

Emission de radio Friday Rocks sur Radio Sud Manche : ici

Ma page de memes : AutisteReddingPhotoshops

-

25/03/2024, 23h21 #2295Banni

- Ville

- expat

J'ai vu une vidéo d'Oussama Amar qui disait que chaque génération en vidéo leur coutait 80 ou 100 $ ... je sais plus exactement mais c'est un ordre de grandeur vraiment différent de la génération d'inage ou de LLM

Sachant qu'une vidéo de 30 secondes c'est 900 images c'est pas déconnant que ca coute au moins 20 $ a générer grand minimum non ?

-

26/03/2024, 00h16 #2296Un thème sombre pour le forum : ça se passe ici.

-

26/03/2024, 07h42 #2297Banni

- Ville

- expat

L'interpolation ca demande aussi de la puissance, surtout que l'IA doit générer un truc cohérent

-

26/03/2024, 13h51 #2298

Cela dit vu que j'ai absolument aucune idée de comment leur logiciel crée une frame après une autre (et si ça se trouve ça utilise déjà de l'interpolation), je sors un peu ça de mon popotin.

Un thème sombre pour le forum : ça se passe ici.

-

12/04/2024, 15h25 #2299Banni

- Ville

- expat

-

12/04/2024, 15h56 #2300

Tutos Youtube Dwarf Fortress, Dungeon Crawl Stone Soup, Cataclysm DDA et Aurora 4X : Gobbostream (synopsis et vidéos à télécharger ici). Chaîne Twitch. Chan CPC mumble Dwarf Fortress dans la section Divers

Tutos Youtube Dwarf Fortress, Dungeon Crawl Stone Soup, Cataclysm DDA et Aurora 4X : Gobbostream (synopsis et vidéos à télécharger ici). Chaîne Twitch. Chan CPC mumble Dwarf Fortress dans la section Divers

-

14/05/2024, 21h06 #2301

-

12/06/2024, 21h09 #2302

Stable Diffusion 3 disponible : https://stability.ai/news/stable-diffusion-3-medium

-

12/06/2024, 23h22 #2303

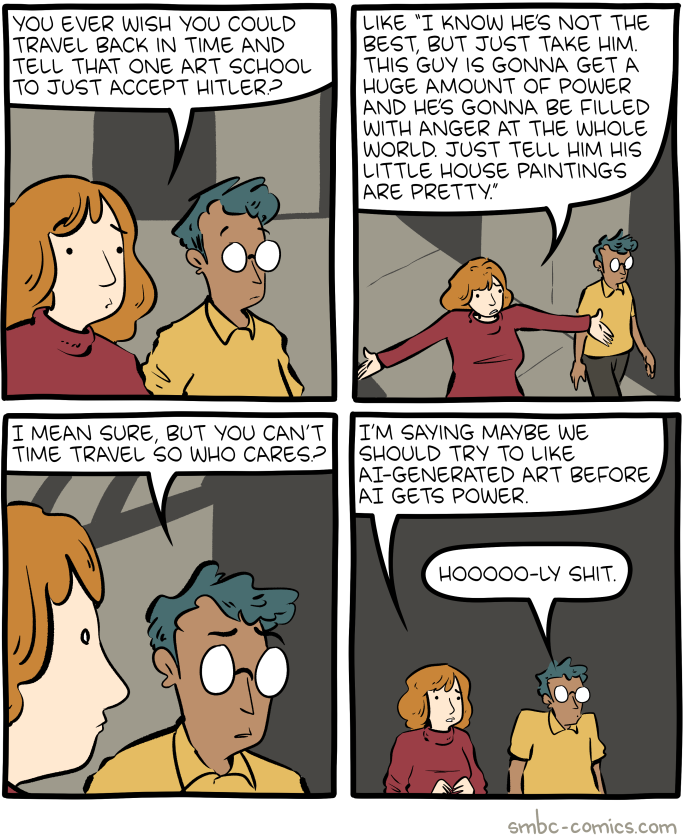

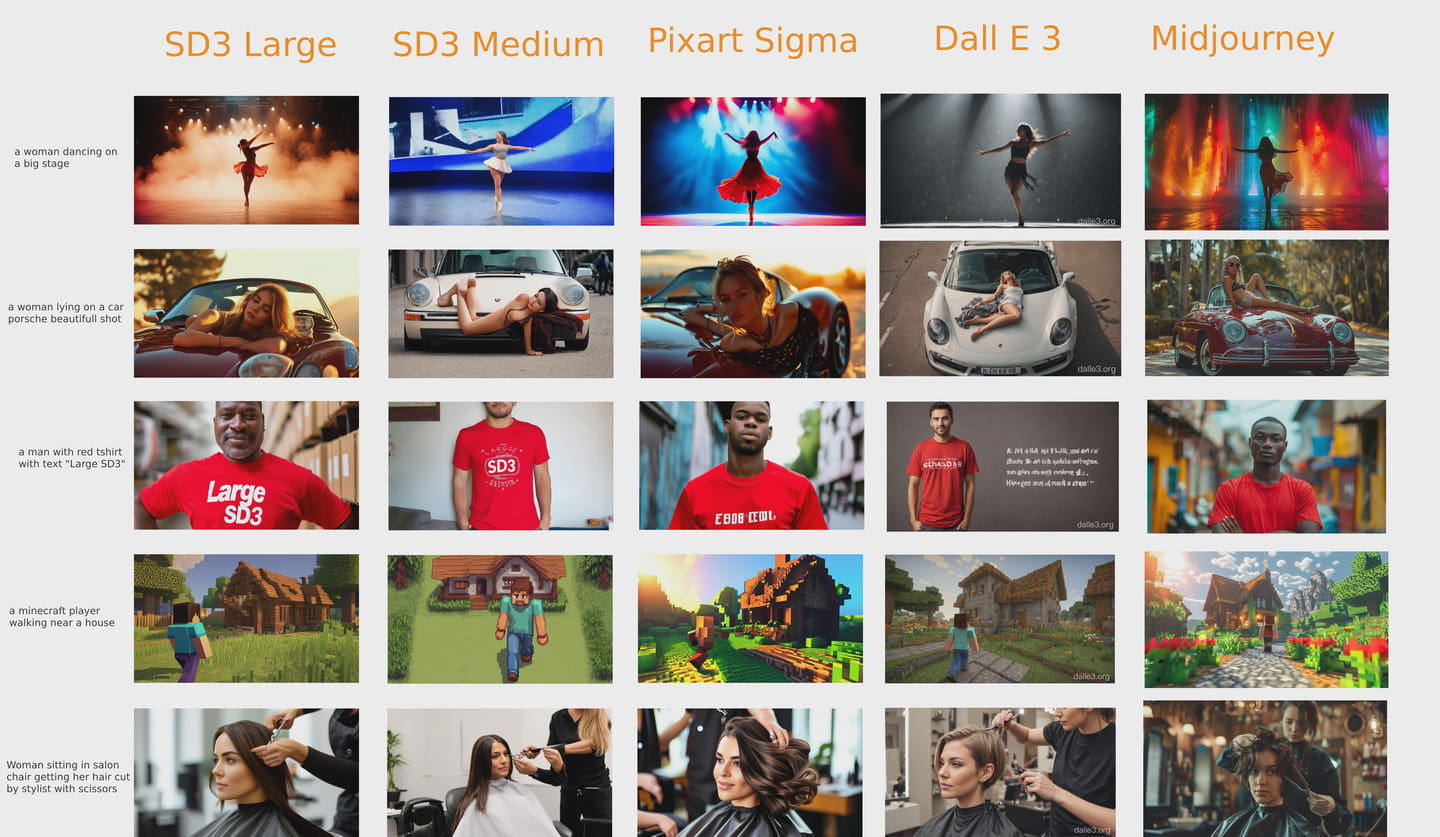

Ça râle fort sur Reddit. SD3 arrive à produire du contenu potable mais galère beaucoup pour l'anatomie (le retour des mains à X doigts entre autres). Peut-être qu'il y aura des progrès comme il y en a eu avec les finetunes de SD 1.5 et SDXL.

Sinon, il paraît aussi que le modèle fourni est de très basse qualité (2 milliards de paramètres) par rapport à celui fourni par l'API (8 milliards).

Ici on voit une comparaison avec le modèle distribué (SD3 Medium) et celui utilisé par l'API (SD3 Large)

Bon, c'est ce que j'ai lu vite fait donc je suis pas 100% sûr de la justesse de mes propos.Un thème sombre pour le forum : ça se passe ici.

-

13/06/2024, 00h24 #2304

Ces générations

Tu m'étonne que ça gueule.

Tu m'étonne que ça gueule.

De mon côté j'ai testé la nouvelle feature de midjourney qui apprend des préférences. On va sur le site, on nous présente deux images et on choisi sa préférée. 200 et quelques itérations plus tard, midjourney est sensé être capable de générer des images plus adapté à mes goûts.

J'ai testé avec le prompt : a monk meditating with a pink duck sleeping on its laps --ar 5:3 --v 6.0

Voici les deux première générations, j'ai fait exprès de ne pas en générer plus pour ne pas choisir moi même :

Sans les préférences :

Avec :

Il n'y a pas à dire, la seconde génération colle beaucoup plus à mes goûts, que ce soit le style ou la composition. Très très cool

-

13/06/2024, 08h35 #2305

Sans les préférences, celle en bas à gauche est ma préférée du lot, juste pour la pagode en arrière plan.

-

14/06/2024, 19h13 #2306

De la génération de vidéos gratuite : https://lumalabs.ai/dream-machine

Un thème sombre pour le forum : ça se passe ici.

-

18/06/2024, 05h11 #2307

Comme promis dans l'autre topic, un petit "behind the scene" d'une précédente participation au concours.

J'avais en tête de faire un vaisseau fantôme moderne.

Je commence à tater le terrain :

zombie pirate ghost ship on foggy water, the ship is a modern AEGIS destroyer from 2015, Canon EOS

Bon pas ouf, déjà c'est pas un destroyer moderne, et le reste...

Donc déjà exit le terme "pirate", c'est trop connoté, puis renforcer le coté tempête fantomatique :

zombie ghost ship on foggy water, the ship is a modern AEGIS destroyer from 2015, heavy storm, lots of water and fog, green surreal lighting, Canon EOS

Ah mieux ! On va rajouter quelques termes pour forcer un coté "wahou" et avoir plus de contrôle sur les couleurs.

zombie ghost ship on foggy water, the ship is a modern AEGIS destroyer from 2015, heavy storm, lots of water and fog, green surreal lighting, Canon EOS, dynamic composition, energetic, spectacular lighting, green and blue tones

Pour essayer de l'aider un peu, je rajoute deux images au prompt :

Pour ce résultat :

Je décide de fine tuner le prompt encore un poil :

zombie ghost ship on foggy water, the ship is a modern AEGIS destroyer from 2015, multiple glowing inside lights, covered in dark green and black mud, scary and decayed, heavy storm, lots of water and fog, green surreal lighting, Canon EOS, dynamic composition, energetic, spectacular lighting, green and blue tones, heavy enormous waves

On change le ratio :

Puis une petite retouche contraste / balance des couleurs / génération IA locale pour les 2-3 défauts / crop :

Dernière modification par Dross ; 18/06/2024 à 05h23.

-

18/06/2024, 12h57 #2308

Pas mal… Je préfère les couleurs de l'avant-dernier jet par contre.

Un thème sombre pour le forum : ça se passe ici.

-

19/08/2024, 11h24 #2309

Y a des canards qui utilisent Flux avec ComfyUI ?

Un thème sombre pour le forum : ça se passe ici.

-

19/08/2024, 11h38 #2310

Oui, j'ai fait quelques essais avec un workflow de base sur Flux-Dev

Répondre avec citation

Répondre avec citation