Affichage des résultats 1 561 à 1 590 sur 9367

-

21/08/2018, 15h41 #1561

-

21/08/2018, 15h44 #1562

Même bien avant la HD2900XT. Le Truform introduit avec la Radeon 8500 c'était déjà de la tesselation.

-

21/08/2018, 16h01 #1563

Mmmh pour le TruForm c'était même Nvidia avec la Geforce 3 qui l'avait introduite en premier mais chacun avait choisi une norme différente :

Les RT-Patches d'un coté contre les N-Patches de l'autre.

edit : lien vers l'article : https://www.hardware.fr/articles/335-1/ati-truform.html

-

21/08/2018, 16h10 #1564

-

21/08/2018, 17h27 #1565

-

21/08/2018, 18h18 #1566

Au niveau des reflets c'est complètement dingue quand même :

Pour la photo virtuelle, ça va être top. Et osef des perfs pour ce genre de truc alors c'est un vrai plus (J'espère vraiment qu'on pourra avoir ce rendu disponible même sur les cartes non architecturées pour, même si ça doit tourner à 5 fps).

Pour le jeu, ça ne sera pas pour cette génération visiblement, ne pas atteindre les 60 FPS@1080p, quand on est de plus en plus à avoir des écrans 21:9/4K/etc qui dépassent les 100Hz c'est inacceptable.

Mais bon, la première génération c'est en général juste pour mettre la technique en place.

-

21/08/2018, 18h30 #1567

Article au vitriol.

Ca laisse présager des perfs décevantes.

https://www.forbes.com/sites/jasonev...the-hype-train

-

21/08/2018, 19h14 #1568Banni

- Ville

- Yvelines

Je me rappelle que j'avais un logiciel de raytracing sur mon Atari ST.

Il fallait des heures voire des jours pour calculer une courte scene en raytracing.

La bonne nouvelle c'est que comme ça existe depuis des dizaines d'années, ça ne doit pas être propriétaire.

Oui avec NVidia c'est souvent le problème.

En tout cas je suis sur que le raytracing, ça va être bof bof sur cette génération car c'est la première.

Vaut mieux pas fantasmer là dessus on risque d'être déçu.

Ce sera mieux dans un an ou deux à la prochaine gen.

-

21/08/2018, 19h22 #1569

-

21/08/2018, 19h24 #1570Banni

- Ville

- Yvelines

Comme je dis sur l'autre topic c'est toujours le même jeu depuis le tomb raider des années 90 sur PS1 avec des plus beaux graphismes.

Sans intérêt si ce n'est un genre d'entente avec nvidia pour vendre des cartes à prix d'or....

Dans cinq ans on y jouera à fond avec une carte à 100 balles, si on est pas mort of course.

-

21/08/2018, 19h44 #1571

-

21/08/2018, 20h06 #1572

Il faut vraiment avoir l'esprit pionnier et vouloir la dernière nouveauté pour raquer dans ces prix.. Oui les reflets sont jolis, mais c'est bien le seul effet qui m'a impressionné.

La palme de la demo la plus lol: Metro Exodus, avec la lumière qui se réfléchie sur la table dans la pièce et qui, oh là là, permet maintenant de cacher un monstre dans la pièce d'à coté car elle est VRAIMENT sombre... (Tomb raider et les danseurs étaient pas mal aussi remarque)

Comme tu dis autant attendre quelques générations

-

21/08/2018, 20h41 #1573

A l'heure ou les joueurs commencent a lorgner sur des résolutions/frames plus élevées, Nvidia arrive avec un retour en arrière sur ces deux points avec pour seul gain des reflets de fou ?

Vu le placement tarifaire très haut de gamme, soit presque 2000$ can la 2080ti et 1500 +/- taxes in pour une 2080, il va vraiment falloir des performances de haut niveau pour faire raquer les joueurs en masse.

Dans mon cas, ecran 144hz qhd / 1070ti : a moins que la 2070 tabasse la 1080ti (qui me permettrais de jouer en ultra sur n'importe quel jeu) pour moins cher, je bougerais pas.

Et puis, au final, la feature en l'état n'a pas non plus d'intérêt pour les joueurs multi, qui ne sacrifieront jamais le framerate pour un gadget.

-

21/08/2018, 20h42 #1574

Au fait je laisse ça : https://www.youtube.com/watch?v=P2Jq4EcV3xk

-

21/08/2018, 20h43 #1575

-

21/08/2018, 20h55 #1576

99% des gens achètent une nouvelle CG pour jouer de manière fluide, pas pour faire des beaux screenshots.

Ils auraient très bien pu attendre que le matos soit réellement capable de gérer ça en temps réel avec un framerate correcte. Le RT c'est l'os à ronger qu'a trouvé Nvidia pour faire oublier que cette gen n'apporte pas grand chose par rapport à la précédente.

L'arrivée du transform & lightning, les pixels shaders etc. ça n'a pas été adopté tout de suite mais le matos était directement exploitable dès les première générations sans que ça défonce les perfs (c'était même plutôt le contraire, le T&L ça a bien boosté les perfs).

-

21/08/2018, 21h11 #1577

Les usages sont en train de changer, sinon Nvidia n'aurai jamais développé Ansel. Et ils pourraient tout à fait rendre le raytracing disponible dans Ansel d'ailleurs. C'est un plus non négligeable pour les gens qui aiment faire de beaux screens.

99% de gens n’achètent pas de CG haut de gamme au prix d'un smic non plus, c'est pas pour ça que c'est pas intéressant.

Pourquoi ? C'est un changement d'architecture pour supporter le raytracing de manière plus complète (le bond est énorme même par rapport aux 1080 TI : la 2070 serai 3-4x plus performante sur cet aspect uniquement). Donc même si ça reste "injouable" pour nos standards, ça reste "la première gen viable" : car ça ne tourne pas à 5FPS non plus.

Est-ce qu'il faut acheter ? Certainement pas. D'ailleurs je suis plutôt rassuré moi même : j'avais fait le pari que cette gen serai décevante et j'ai pris une 1080 Ti le mois dernier. Au final, c'est même pire que ce que je pensais (j'imaginais 2080 > 1080 Ti, et on en est loin).

-

21/08/2018, 21h19 #1578

-

21/08/2018, 21h28 #1579

C'est pas un argument de vente, c'est un à côté sympa. Personne n'achète une GTX 1080Ti pour Ansel.

Le bond n'est "énorme" qu'en Ray Tracing. Sachant que la RTX 2070 est déjà 40% moins performante qu'une RTX 2080Ti qui crache ses poumons pour sortir 30 fps en 1080p sur Tomb Raider. La techno n'est pas réellement exploitable en l'état. Nvidia la sort maintenant pas parce que c'est réellement prêt mais parce qu'ils n'ont rien à montrer pour donner envie d'acheter cette nouvelle génération.Pourquoi ? C'est un changement d'architecture pour supporter le raytracing de manière plus complète (le bond est énorme même par rapport aux 1080 TI : la 2070 serai 3-4x plus performante sur cet aspect uniquement). Donc si ça reste "injouable" pour nos standards, ça reste "la première gen viable" : car ça tourne ne pas à 5FPS.

Est-ce qu'il faut acheter ? Certainement pas. D'ailleurs je suis plutôt rassuré moi même : j'avais fait le pari que cette gen serai décevante et j'ai pris une 1080 Ti le mois dernier. Au final, c'est même pire que ce que je pensais (j'imaginais 2080 > 1080 Ti, et on en est loin).

La révolution du Ray Tracing en temps réel c'est pas pour cette génération, pour l'instant c'est rien qu'un coup marketing, un teaser vendu à prix d'or.

- - - Mise à jour - - -

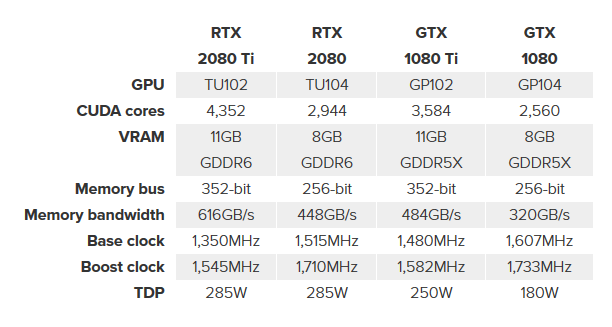

Fréquences qui stagnent, nombre de cœurs (hors Ti) qui stagne, process à peine plus fin, le TDP en hausse, pas de vrai changement d'archi si on exclu la partie Ray Tracing. Et enfin Nvidia avait lourdement insisté sur le bond de perf entre Maxwell et Pascal, et ici bizarrement pas un mot. Juste des screens et des vidéos pour montrer des jolis effets de lumière.

-

21/08/2018, 21h38 #1580

La fiche technique :

Je sais que l'influence de la mémoire et de l'archi peuvent améliorer les choses, mais bon le reste c'est pas fameux : moins de VRAM, moins de CUDA cores et le reste presque pareil.

Et Nvidia s'est bien gardé de faire une comparaison dans sa communication. Ne vous faites pas trop d'attentes.

- - - Mise à jour - - -

Bah perdu, j'ai acheté du Nvidia les yeux fermés à cause des "à cotés" de la marque : soit Ansel/Shadowplay/PhysX/GSync/etc. Donc c'est bien un argument de vente, pas le seul, mais ça compte. Si y'avais pas eu cette offre à coté, j'aurai au moins regardé chez les rouges ce que j'aurai eu pour le même prix : je ne l'ai même pas fait, j'ai même aucune idée de ce qu'ils font actuellement, alors que j'alterne entre les vert/rouge depuis des années.

Là tu rajoute le raytracing sur la pile de trucs que tu obtiens en étant chez les verts, ça enfonce le clou.

-

21/08/2018, 21h43 #1581

Donc pas Ansel en lui-même. Et ton cas est suffisamment généralisable pour en tirer quelque chose d'autre que toi tu as pris une GTX 1080Ti pour ces raisons? Sans ça tu aurais pris une Vega 64 qui consomme plus, chauffe plus et est moins performante tout en étant vendue au même prix?

Sachant qu'en plus ces à côtés sont aussi dispo sur une GTX 1060 3go toute bête pas besoin de taper dans l'ultra haut de gamme pour y accéder. Et de toute façon si c'est pour faire des screens on a pas besoin non plus de sortir 800€ pour une cg taillée pour envoyer du 60fps en 1440p/4K.

Les 1080Ti se vendent parce que ce sont les plus puissantes, c'est leur première raison d'être.

-

21/08/2018, 21h49 #1582

J'ai jamais dis que c'est une killer feature non plus tu remarquera.

Je dis juste que c'est un truc en plus face à la concurrence, et que la liste commence à être très longue.

Les fonctionnalités te verrouille dans la marque, et tes besoins (3440x1440@120hz dans mon cas) définissent le modèle.

Donc pour Nvidia, ça a du sens de sortir le raytracing : ça reste un plus sur leur (longue) liste, même si ça risque d'être uniquement utilisé par les monteurs de gameplay/youtubers (en replay, comme sur PUBG) et photographes virtuels au début, et quelques joueurs pas trop regardant.

-

21/08/2018, 22h05 #1583

Du coup on joue pour prendre des screenshots ?????

J'ai l'impression que ma 1070 a encore de belles années devant elle... Déjà 2 ans, encore toutes ses dents.

mais bon attendons les benchs.... sans Ray Tracing.

(et c'est bon on prend les paris, dans quelques temps on ne parlera plus que de RTX, et pas de Ray tracing, bien vu Nvidia)

-

21/08/2018, 22h42 #1584reneyvaneGuest

La GDDR6 est en pourcentage combien de fois plus rapide que la GDDR5X ? Je remarque que même si la XboxOneX utilise un gpu AMD, elle à la même bande passante qu'une 1080, quid des performances ?

-

21/08/2018, 23h08 #1585

Hier ça bandait dur et aujourd'hui tout le monde est mou.

Attendez simplement les benchs, et vous vous ferez un avis.

- Si en effet on parle d'un bon de perf très moyen, bah très bien ça fera des économies.

La vraie question : quand sortent ces benchs ?

-

21/08/2018, 23h14 #1586

Le 20 septembre, non ?

-

21/08/2018, 23h28 #1587

Je serais pas surpris que digital foundries et la presse fasse mumuse avec dès la semaine prochaine

-

21/08/2018, 23h29 #1588

Ca sera sûrement comme les 5 dernières générations de cartes, à savoir un bond de ~20-30% de perf réelles à modèle équivalent par rapport à l'ancienne génération. Et il faudra comme d'habitude attendre 2 ans pour avoir une prochaine génération avec un nouveau bond de ~20-30%.

Ils sortiront sûrement une 2090 et des Titan entre temps vu que la 2080ti est déjà sortie.

-

21/08/2018, 23h52 #1589

Avec plein de gigarays et de RTX-ops !

-

22/08/2018, 03h08 #1590

J'ai quand même lu que c'était des cartes pour jouer en 4K et a haute fréquence, si le bond en perf est si minime, y'a une couille quelque part.

Répondre avec citation

Répondre avec citation