Affichage des résultats 901 à 930 sur 9367

-

20/07/2017, 14h58 #901

-

20/07/2017, 16h32 #902

Je regardais sur le CDH.

Rumeur: la Vega concurrencerait la GTX 1080 pour 100 dollars de moins.

Problème, si c'est vrai, la marge d'AMD va être aussi fine que de la dentelle, ensuite Nvidia marge comme un porc actuellement, donc a toute latitude pour baisser le prix des GTX 1080 au cas où...

-

20/07/2017, 16h43 #903Banni

L'autre problème, c'est qu'aujourd'hui une alim 500W suffit amplement même pour une grosse config avec 1080. Perso ca me ferait un peu chier de changer d'alim puis de pomper une centrale nucléaire pour jouer... Je trouve ça un peu ridicule de dire "hey hey on arrive à faire aussi bien qu'une 1080 et pour moins cher" alors qu'il arrivent 1 an après et consomme au minimum 30% de plus...

A ce prix, si le consommateur veut ce niveau de puissance, il filera 100$ de plus et se prendra une 1080. En tout cas c'est ce que je ferais.

A cela s'ajoute un event moisi à budapest alors que ca fait des mois qu'ils annoncent vega comme une pseudo révolution...

Chuis super déçu pour le coup.

Pour info, j'ai une rx470 (msi gaming x machin) que j'avais pris "en attendant"....

-

20/07/2017, 16h51 #904

God bless le Freesync, sans ça ça fait longtemps que j'aurai mis la R9 290 à la retraite. Maintenant je crois qu'elle va encore devoir tenir 1 an le temps que Navi se pointe.

-

20/07/2017, 16h58 #905

-

20/07/2017, 16h59 #906Banni

-

20/07/2017, 17h13 #907

-

20/07/2017, 17h15 #908

-

20/07/2017, 17h48 #909

-

21/07/2017, 07h55 #910Banni

- Ville

- ¯\_(ツ)_/¯

Question, il y a moyen de voir un exemple de ce que permet la freesynch? Car la théorie c'est bien mais je préfère la pratique.

-

21/07/2017, 08h20 #911

-

21/07/2017, 09h52 #912Banni

- Ville

- ¯\_(ツ)_/¯

-

21/07/2017, 10h13 #913

Disons qu'à la Fnac pour voir une démo d'une technologie clairement destinée au JV PC, je suis pas du tout convaincu que tu vas l'avoir. Au mieux le vendeur saura te dire quel écran l'a mais incapable de te lancer une démo fonctionnelle te montrant la différence.

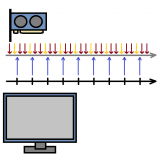

Si on simplifie Freesync: sans Freesync, à 40 ou 50 fps tu ressens des petites saccades, le jeu est légèrement haché. Avec Freesync le jeu est fluide, et même à 30fps si tu as le LFC sur l'écran. Malgré tout tu n'as pas de déchirement de l'image si jamais tu dépasses la fréquence maxi de l'affichage car tu peux activer la Vsync ; si FPS > fréquence maxi, il va afficher juste autant d'images que la fréquence maxi (pas de déchirement). Si FPS < fréquence maxi, alors fréquence réelle de rafraîchissement = FPS, et ça évolue en dynamique. Comme l'écran n'attend pas d'images, n'affiche pas d'images en double et autres conneries du passé, mais qu'il affiche simplement les images dès qu'elles sont prêtes à être affichées, bah tu as une vraie impression de fluidité. C'est particulièrement utile lorsque la carte graphique est dimensionnée "au plus juste" ou même un peu en dessous par rapport à la définition de l'écran. C'est bien aussi quand la carte graphique vieillit ; ma R9 290 me permet ainsi toujours de jouer à tout, en 2560x1440 et en bons niveaux de détails, sans souffrir de saccades.

Youtube affiche des vidéos sur TON écran actuel, lequel n'a pas Freesync. Donc tu ne verras jamais l'effet de freesync puisque rien ne peut magiquement lui permettre de se synchroniser avec le débit de ta carte graphique. C'est comme regarder sur le net une vidéo de jeu en 144Hz avec un écran 60Hz devant les yeux, tu ne te rends compte de rien. Pour les écrans il est impératif de se faire une expérience réelle, y'a pas d'ersatz.

Pour tempérer un tout petit peu: j'ai déjà eu des soucis avec Freesync et je dois parfois l'activer ou le désactiver selon le jeu. C'est peut-être lié à l'implantation de mon écran (Freesync cappé à 90Hz alors que l'écran fait 144Hz). En gros sur Fifa 17 j'ai des saccades sur les animations des joueurs avec FS activé, c'est bizarre. Si je le vire j'ai plus aucun souci. Sur Divinity Original Sin le jeu me fait un écran noir la moitié du temps si j'active Freesync, au lancement du jeu. Obligé de débrancher l'écran et de le rebrancher pour que ça marche. Du coup, pareil, la solution est de désactiver Freesync avant de jouer (heureusement le jeu tourne à 100fps+ donc je ne remarque pas de différence pratique).

-

21/07/2017, 10h25 #914

-

21/07/2017, 10h28 #915

Bah c'est plus que t'as pas souvent besoin de Vsync en fait. C'est rare d'avoir un jeu dont le CPU ET le GPU permettent de dépasser 144fps. Sur GTA5 par exemple ce ne sera pas avant 2022.

-

21/07/2017, 10h47 #916

-

21/07/2017, 10h48 #917

-

21/07/2017, 11h00 #918

Le déchirement d'image n'intervient que si tu calcules PLUS d'images que ce que peut afficher l'écran (FPS>144). Dans un tel cas l'écran commence à se rafraîchir et en cours de route une nouvelle image est déjà disponible, il affiche donc cette seconde image sur la partie basse = déchirement. Si l'écran se rafraîchit plus vite que ce qu'envoie la carte graphique (FPS<144, cas fréquent en 144hz), tu n'as pas de déchirement, seulement des refreshs qui se font "à vide" en réaffichant une même image 2x d'affilée. Vu la rapidité de rafraîchissement ce phénomène n'est pas vraiment perceptible et tu ne constates donc rien à l’œil.

-

21/07/2017, 11h08 #919

Euh, une vidéo youtube que tu vas regarder sur ton écran 60 Hz classique ?

C'est à peu près comme regarder une vidéo de quelqu'un jouant à 144 Hz, mais sur ton écran 60 Hz, et ça n'a pour ainsi dire aucun intérêt...

C'est pour ça qu'il faut le tester en live !

Effectivement, selon le jeu je limite à 144 ou à 72 et c'est pépère.

C'est vrai que ça tire sur le CPU et c'est impossible de le tenir sur tous les jeux.

Mais sur The Witcher III, par exemple (et qui est un minimum gourmand quand même), j'arrivais à tenir 100+ avec un i5-4670K @4.4/4.1 Ghz et une 980 Ti/1070.

A voir si je peux faire pareil avec mon Ryzen une fois que je l'aurai OC, mais pour ça il me faut une carte mère qui démarre... J'en aurai ptet une dans un mois, avec de la chance...

Tu peux enlever les " ", tout ce que tu dis là n'est que pur vérité... Et encore pour Star Citizen je te trouve optimiste.

", tout ce que tu dis là n'est que pur vérité... Et encore pour Star Citizen je te trouve optimiste.

Si tu as un écran 144 Hz classique, ben avec Vsync effectivement (comme sur tous les écrans du monde) tu te débarasses du tearing.

L'important est d'avoir une config qui tienne au moins les 72 fps dans ce cas.

- - - Mise à jour - - -

J'avais fait un super (si je puis me permettre ?) topo avec des schémas sur le topic des CG, ce serait cool de retrouver où...

-

21/07/2017, 11h32 #920

-

21/07/2017, 11h36 #921

-

21/07/2017, 11h37 #922

-

21/07/2017, 11h46 #923

-

21/07/2017, 11h47 #924

Et bah? Si tu lis le truc de taro tu vois bien que sans Vsync avec un 144Hz non adaptatif (GS ou FS), l'écran affiche toujours la dernière image. Je vois pas à quoi ça sert d'activer la Vsync si tu as par exemple 100 ou 110fps calculés. Autant afficher 100 ou 110 images et pour les 30 ou 40 fois où l'écran se rafraîchit sans qu'une nouvelle image ne soit dispo, il va réafficher la même une deuxième fois. A la différence de la Vsync cela se fait ponctuellement, l'écran ne divise pas son taux de rafraîchissement par 2 sur une seconde entière.

-

21/07/2017, 11h57 #925

Je n'en ai aucune idée

Je me demande si c'est vraiment sur une seconde entière, ou si c'est moins.

A mon avis, ça doit même fortement dépendre à minima du combo archi GPU/driver, et peut-être du jeu dans une moindre mesure...

Dans tous les cas, on est d'accord sur un point : si on est essentiellement en dessous des 144 fps, mais suffisamment au-dessus des 72, autant être en mode immediate. Pour 100-110 fps ça me parait valable.

Par contre à 80 fps, la question ne se pose pas (pour moi) : autant fixer directement à 72 (Vsync adaptative à la moitié de la fréquence de rafraîchissement, dans les paramètres Nvidia).

-

21/07/2017, 12h03 #926

-

21/07/2017, 12h21 #927

-

21/07/2017, 13h47 #928

-

21/07/2017, 14h24 #929

C'est le chiffre de base sur Windows(et les pilotes Nvidia) par contre je suis pas certain que la valeur du DWM(Desktop Window Manager utilisé par Win Aero) suis à 1 ou 3(je trouve pas grand-chose de concluant) d'où le "apparemment" que j'ai mis dans ma réponse d'avant.

-

21/07/2017, 15h13 #930

Répondre avec citation

Répondre avec citation

.

.